|

|

|

|

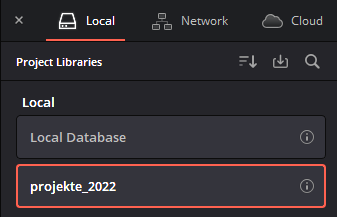

Vor

einem Upgrade auf die Version 18 empfehle ich eine Windows Systemsicherung. Ferner

wird die Sicherung der lokalen

Datenbank vor einem größeren Upgrade

empfohlen, auf diese Weise kann man bei Bedarf zur vorherigen Version

zurückkehren. DaVinci

Resolve 18 erfordert ein Upgrade der Projektbibliothek von DaVinci

Resolve 17.4.6 oder früheren Versionen. Vor dem Upgrade auf die neue

Version sollten deswegen auf jeden Fall die bestehenden Datenbanken (DiskDB als

auch PostgreSQL

falls man einen Server hat) auf eine interne Festplatte gesichert

werden, es muss nicht "C"sein. Die

Datenbasis muss einen leeren Ordner gelegt werden. Eiene neue Database

muss in

kleinbuchstaben geschrieben werden, z.B. "projekte_2022". Die Sicherung

der alten Database ist wichtig, falls man man zu einer vorherigen

Resolve-Version

zurückgehen müßte. Nach dem Start der Version 18, werden folgende Sprachen für die UI angeboten, die Deutsche Sprache ist dem Hersteller noch nicht geläufig...:

Beachten: ab 12.04.2024 ist die Version 19.0 als Public Beta-Update, nun auch deutschsprachig erschienen. Für deutschsprachige Anwender ohne Fremdsprachenkenntnisse hat Blackmagic vor einigen Jahre die obige Printausgabe über die Bedienung von DVR 15 mit 389 Seiten herausgebracht. Zwischenzeitlich gibt es eine kostenlose PDF-Datei mit der man sich zufrieden geben muss. Die grundsätzlichen Bedienungselemente haben sich seit meinem persönlichen Einstieg über die Versionen 15 bis zu 18 hinweg nicht geändert. Einführung in die Audiopostproduktion mit Fairlight und DaVinci Resolve 15(für deutschsprachige Anwender): Klick! Man kann sich von BM auch die Bedienungsanleitung zum "Cintel Scanner" als PDF runterladen, dort gibt es eine deutschprachige Anleitung für DVR 17 ab Seite 409 bis 453: Klick! Im Dezember 2022 hat Blackmagic endlich zumindest eine ergänzende 400-seitige englichssprachige PDF für Coloristen geliefert:

Übersicht dazu mit Lehrgängen: Klick! New Feature Guide Public Beta(60 Seiten): Klick!

Der New Feature Guide Public Beta für die Beta-Version 18.5 ist am 18.04.2023 veröffentlicht worden.

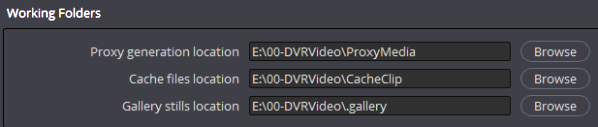

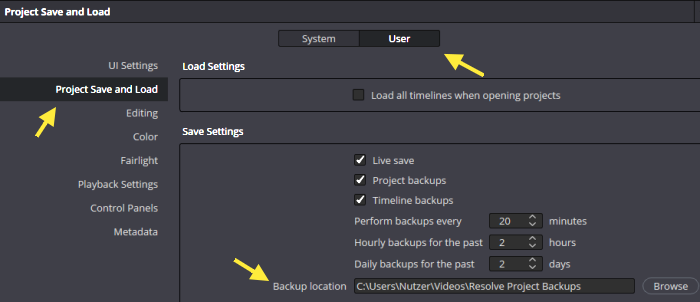

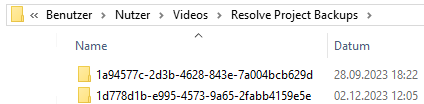

Fusion - Hollywoods Geheimwaffe: Es ist unglaublich was Blackmagic zu einem günstigen NLE-Preis mit DaVinci Resolve auf die Beine gestellt hat, dazu gehört auch Fusion... Hier gibt es eine Übersicht über die Fusion-Fähigkeiten: Klick! Ich persönlich habe damit bisher nur ein paar Kleinigkeiten geübt. PC-Speichereinrichtung für den DVR-Videoschnitt: Wie Sie Ihr Resolve-Projekt archivieren! - Exportieren Sie Ihre Resolve-Arbeit zur späteren Verwendung! --> Klick!  Ich arbeite als Hobbyvideofilmer rein Local, die beiden anderen Möglichkeiten benötige ich nicht. Arbeitsordner:  Einstellung in: File/Project Settings/Master Settings/Working Folder Wo sind denn bloß meine Daten ? fragt sich Prof. Uli Plank: Klick! Wo speichert Davinci Resolve Backup-Dateien?: Klick!Project Save and Load:  Die Einstellung findet man normalerweise auf der Systemfestplatte über das Menü DaVinci Resolve/Preferences/User,

dieser Ordner kann sehr schnell überlaufen, ab und an sind deshalb nicht benötigte Inhalte zu löschen.  Backup-Projektspeicher auf C

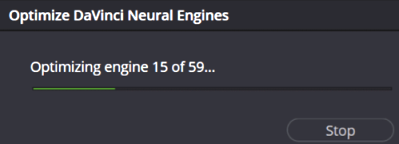

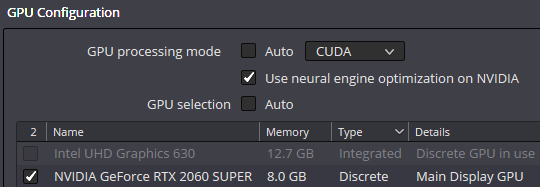

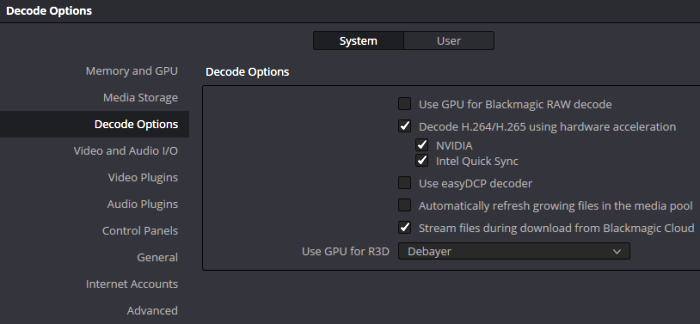

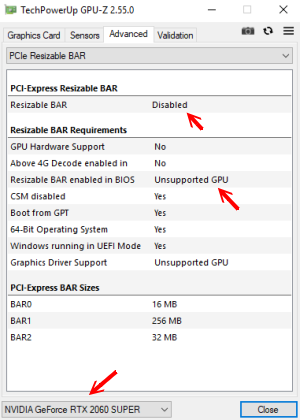

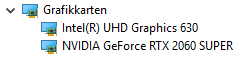

Optimizing DaVinci Neural Engines(KI) ab 14.09.2023: Bei der Vorstellung des DaVinci Updates 18.6 verspricht Blackmagic bei Einsatz von RTX Nvidia Grafikkarten eine höhere Leistungsentfaltung mit bis zu 2x schnellere Neural Engine-Leistung(BM-Bezeichnung für die KI-Technologie). Eine NVidia GeForce RTX 2060 Super mit 8GB Speicher arbeitet auch in meinem Videoschnitt-PC aus dem Jahre 2020. Neat Video V5 in DaVinci Resolve Studio 17 ist im Entrauschungstest meines Panasonic FZ-300 UHD-Videomaterial so abgearbeitet worden bei FHD-Timeline-Auflösung: mit CPU: 12,6 fps mit CUDA-GPU: 31,2 fps mit CPU + GPU: 22,5 fps Das ist nicht mit der Intel-GPU möglich, deshalb favorisiere ich die RTX-Grafikkarte! KI-Optionen unterstützen:  Prüfung der RTX-Grafikkarte von NVidia auf Eignung  Zulassung fir Optimierung der KI-Optionen Mehr Information über die hiermit unterstützten KI-Effekte: Klick! KI in DaVinci Resolve - fünf Lieblingsfunktionen: Klick! Decode Options:  Hardware Einstellung der nutzbaren Hardware-Grafikeinheiten für H.264 und H.265

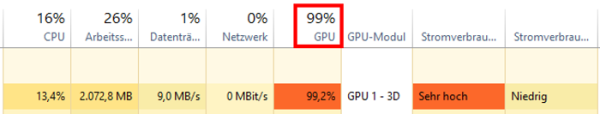

Mit dem Task-Manager kann man überprüfen welche Grafikeinheit mit bester Wiedergabe-Leistung DaVinci Resolve unterstützt - GPU 0(NVidia) oder GPU 1(Intel Graphics 630). In meinem Fall ist das die GPU 0. Siehe auch: Klick! In meinem Fall liefert die GPU der NVidia-Grafikkarte die beste Performance. +++

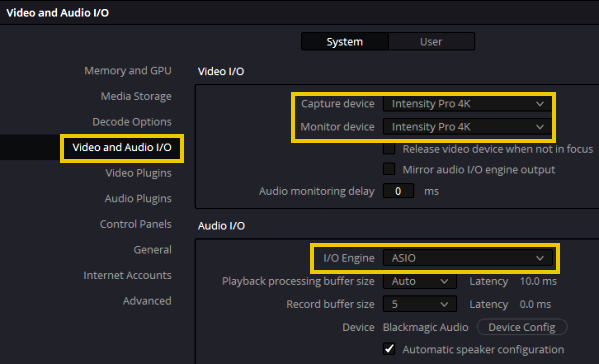

Preferences Video and Audio für die Blackmagic IntensityPro 4K I/O-Videokarte:  Siehe

User Preferences ab

Seite 11 der Bedienungsanleiting und PC-

Ausstattung hier

Mittlerweile habe ich auch die aktuellste Blackmagic_Desktop_Video_Windows_12.4 Software für die BM I/O - Videokarte Intensity Pro 4K installiert über die ich die Vorschau auf einen 32" HDR-TV geliefert bekomme. Vorsicht! Aktuell(05.07.2023) spielt die Version 12.4.2 des Gerätetreibers für die Blackmagic I/O-Intensity Pro 4K Steckkarte im PC eine wichtige Rolle für die Live-Vollbildausgabe von der Timeline aus auf den 32" HDR-TV 1080p für das auf diesem PC installierte NLE EDIUS X und DaVinci Resolve 18. Man kann den Treiber hier runteladen: Klick! Das ist neu in DaVinci Resolve 18: Blackmagic hat sehr viel Neuigkeiten in die Version 18 reingepackt die ich persönlich nie brauchen werde. Ein jeder muss für sich persönlich prüfen was er davon wirklich benötigt.

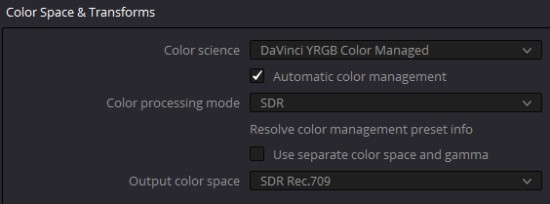

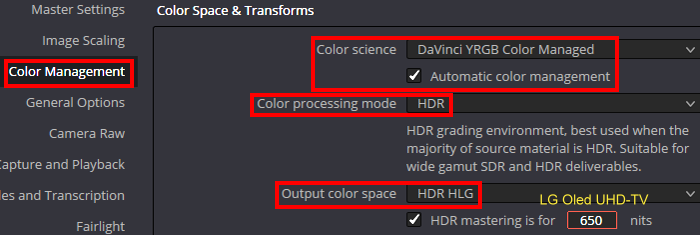

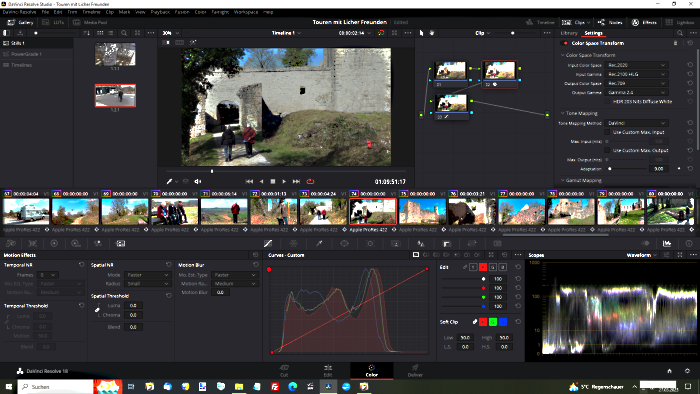

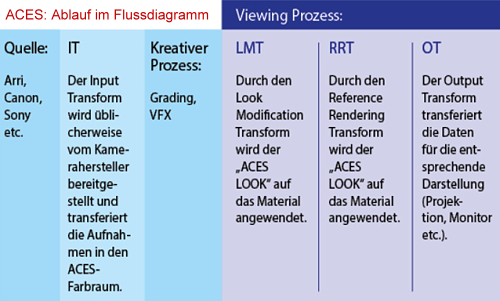

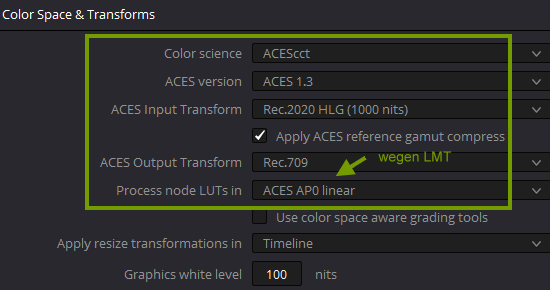

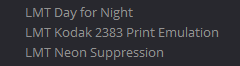

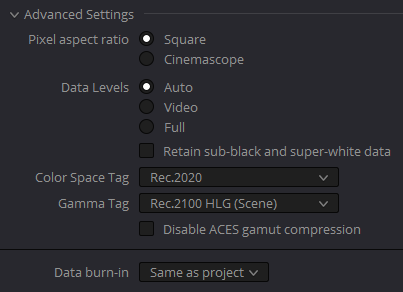

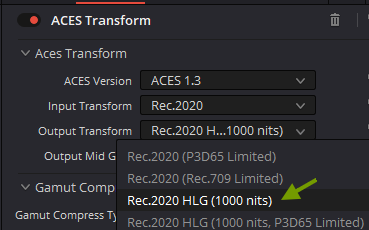

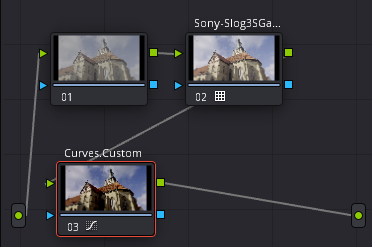

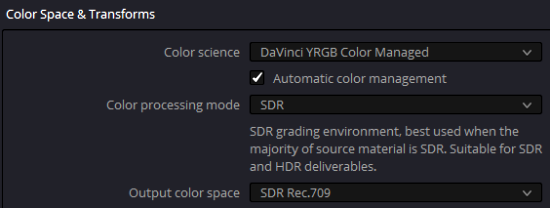

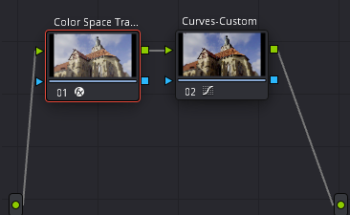

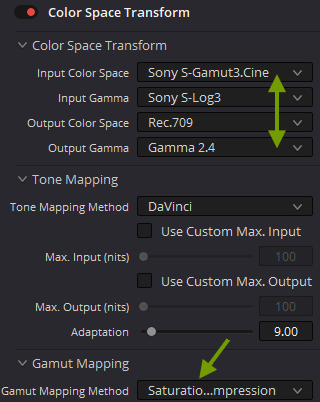

Die Farbverwaltung in DaVinci Resolve lässt sich auf Timeline-Ebene konfigurieren. Dies ermöglicht es, bei Projekten mit gemischten Medien unterschiedliche Timeline- und Ausgabe-Farbräume vorzugeben. Die Vorteile von Color Management: Klick! Wichtig: Bevor man das Projekt in DaVinci Resolve anlegt, sollte man wissen welche Eigenschaften das Video hat. Normalerweise nutzt man dafür das kostenlose Tool "Media Info" welches alle nötigen Daten liefert, auch für HDR-Projekte. Im Falle der Sony Slog-Aufnahmeprofile ist es besser die Eingenschaften des Videos mit dem kostenlosen Sony Catalyst-Browser zu ermitteln:  Diese Eigenschaften werden nicht von "Media Info" geliefert!

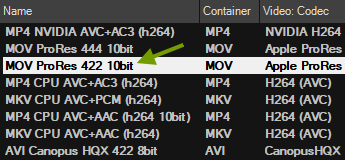

Zusätzliche Effekte und Vorlagen:. Beispiel-Link zu eine Internet-Anbieter: Klick! Bisher zugekaufte Plug-in: Zusätzliche NewBlue Elements 3 Overlay FX-Plug-in: Was dabei rauskommen soll: Klick!   Zusätzliche Elements Plug-in, deutschsprachig in Resolve Die Settings zu den sieben neuen Funktionen erscheinen ebenfalls größtenteils deutschsprachig. So wird Active Camera bedient: Klick! So wird Flying PIP bedient: Klick! So wird Image Mapper bedient: Klick! So wird Picture Grid bedient: Klick! So wird Picture in Picture bedient; Klick! So wird Picture in Shape bedient: Klick! So wird Split Screen bedient: Klick! Tutorial für Flying PiP: Klick! Vorbereitung des Videomaterials: Stabilisierung, Grobschnitt, ProRes 422: Da ich im Falle der HDR-Videobearbeitung über kein kameraseitiges 10 Bit Rohvideo verfüge, mache ich per Transform in Mercalli V6 von ProDAD mittels Exportkodierung aus 8 Bit das 10 Bit Videomaterial selbst. Das 8 Bit Videomaterial wird uns noch lange begleiten, auch im Fernsehen. Die Video-Story wird in MV6 auf der Zeitleiste mittels Clip-Verschieben zusammengestellt. Es ist sehr sinnvoll den Grobschnitt und die Qualitäts-Videoszenen-Nachstabilisierung in Mercalli incl. C-MOS- und Rolling-Shutter- Fehlerkorrektur gleich mit durchzuführen und die Ergebnisse dann in ProRes 422 10Bit zu exportieren für die weitere Bearbeitung in DaVinci Resolve Studio. Der Grund ist, weil Kameramaterial in H.264 oder H.264 ein Longgop Material ist und deshalb schlecht im Videoschnittprogamm nachzuarbeiten ist. Besser ist es mit All-Intra Videos ohne Verlust zu editieren. Beschreibung von Filmmaking Elements zum Umgang mit 8 Bit Video im Color-Arbeitsraum: Klick!  Auswahl der All-Intra Kodieren Das ist auch vor allem deshalb sinnvoll weil die Szenen-Nachstabilisierung in DaVinci Resolve bei einer evtl. Clipkürzung mitten in der Arbeit verloren gehen kann und es einfach lästig ist dort erneut nachzustabilisieren. Es ist deshalb besser die Videobildnachstabilisierung extern von DaVinci Resolve durchzuführen. Mit Mercalli V6 und DaVinci Resolve bei der Clipstabilisierung zusammenarbeiten fast wie mit einem Plug-in:

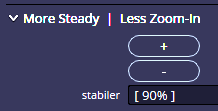

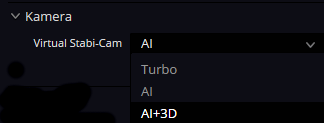

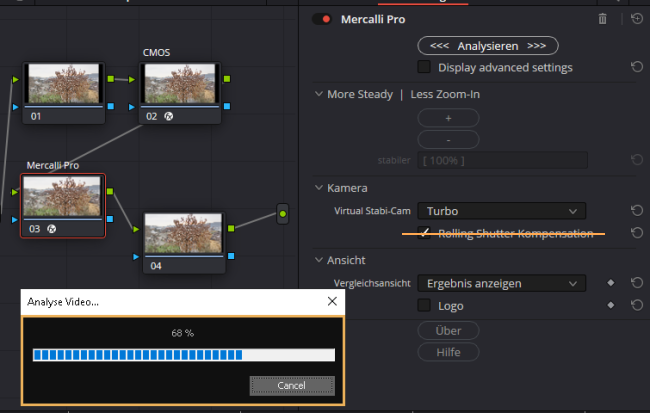

Siehe auch - How to h265 for Editing - Transcoding ohne Verlust für besseres Editing: Klick! Videoschnitt Problem; Klick! Dramaturgie und Grobschnitt: Klick! Mercalli 6 Pro Typ OFX von ProDAD am 17.03.2025 neu erschienen: Videostabilisierung,

CMOS-Korrektur, Fisheye-Entfernung und Bildoptimierung als Plugins für

OFX-kompatible Bearbeitungslösungen. Ich habe die Lizenzversion erworben.  Der Picture Enhanzr RT funktioniert bei mir nicht! Bei einem kombinierten CMOS Fixr + Mercalli Pro Einsatz muss Mercalli Pro immer im Node hinter dem CMOS Fixr eingesetzt werden und der Rolling-Shutter ausgeschaltet werden. Nach einer Änderung der Settings in CMOS Fixr muss Mercalli Pro erneut gestarten werden.  Die Stabilisierung kann durch stärkeres Heranzoomen verbessert werde.  Drei starke Stabilisierungsmethoden  Aufforderung die Videoanalyse erneut zu starten  Die Analyse läuft hier mit CMOS und ohne Rolling-Shutter im Turbo-Modus

Die Anzeige der Stabilisierungsdiagramme funktionter nicht zufriedenstellend:

Download: Klick! Benutzerhandbuch-Online: Klick! Nachstabilisierung von Freihand- Videoaufnahmen. Die programmeigene Videostabilisierung in DaVinci Resolve aus dem EDIT-Arbeitsraum heraus hat den Nachteil, dass die durchgeführte Stabiliiserung bei dem Verschieben von Clips oder einer kleinen Änderung der Filtereigenschaften verloren gehen kann und es im Clip dann wieder unruhig wird. Man wird dadurch gezwungen die Videostabilisierung komplett zu kontrollieren und ggf. erneut durchzuführen.  Die oben durchgeführte Stabilisierung geht verloren, wenn der Clip etwas verschoben oder seine Eigenschaften etwas geändert werden. Es ist deshalb besser die benötigten Videoclips in Mercalli V6 SAL vor dem Import in DVR zu stabilisieren.

Zwar verfügt DaVinci Resolve über eigene Stabilisierungstools, es verfügt aber

nicht z.B. über die Fähigkeiten CMOS-Fehler der Aufnahmekamera bei Bewegungs-/Action-Aufnahmen

auszubügeln.

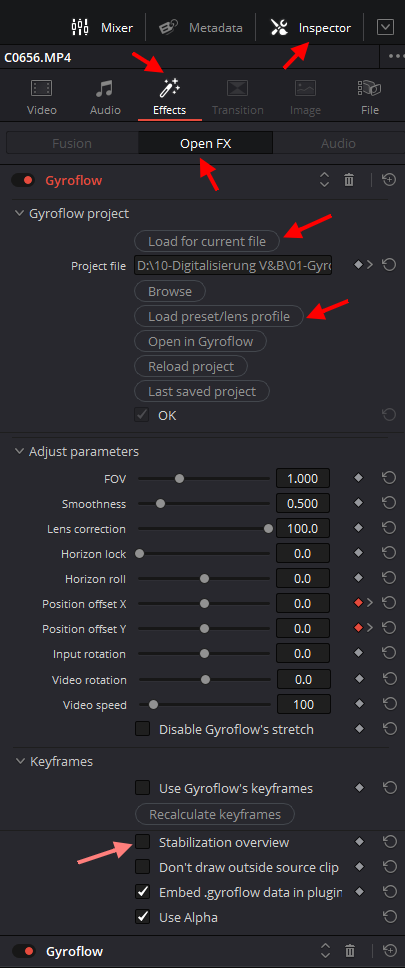

In Mercalli 6 SAL kann man ganze Serien von Clips auflegen und neben der Stabilisierung auch gleich den Grobschnitt sowie mittels Drag-and-Drop die Videoclips zu einer Story zusammenschieben. Den dortigen Export kann man in ProRes 422 HQ(10Bit) praktisch verlustlos in eine einzelnen Videodatei oder gar eine ganze Serie von Videodateien unterschiedlich tief in Mercalli 6 SAL nachgearbeitet - ja nach Bedarf - und dann alles in die Resolve-Timeline importieren und dort den Feinschnitt, die Farbkorrektur, das Color-Grading und andere Arbeitsgänge erledigen. Die Vorbereitung der Videoclips in Mercalli 6 SAL ist auch für einen Resolve-Editor super hilfreich, weil er die Nachstabilisierung nicht in Resolve durchführen muss! Zu meinem persönlichen Erfahrungsbericht Mit ProDAD Mercalli 6 SAL: Klick! Neu in 2022: Gyro-Stabilisierung/Nachstabilisierung mit Gyro-Metadaten: Camera Gyro: Wenn Ihr Filmmaterial von einer Blackmagic Cinema Camera stammt, die über ein Gyroskop verfügt, wird diese Option im Dropdown-Menü angezeigt. Sie können das Filmmaterial auf der Grundlage der Kamerabewegungs-Daten stabilisieren die vom internen Gyroskop aufgezeichnet werden, die in den Clip eingebettet sind. Siehe Seite 3258 im "Colorist Guide". In dieser Kamerapräsentation hat Blackmagic das Geheimnis vom Gyroskop in den folgenden drei BM-Kameras, mit denen bisher keine Freihandaufnahmen im Gehen gemacht werden konnten, gelüftet: KLick!  Für andere Kamera-Marken ist diese Stabiliierungsoption in DaVinci Resolve nicht zugänglich! Natürlich haben auch andere Kameras einen eingebauten Gyroskop, wie z.B. die Vlogger Kameras Sony ZV-E10 oder auch meine Sony ZV-1. Gyroflow als OpenFX Plugin für DaVinci Resolve: Darauf haben viele Videofilmer gewartet die mit DVR editieren, Gyroflow OpenFX Plugin soll direkte Stabilisierung in DaVinci Resolve ermöglichen. Das Plugin kann man hier runterladen: Klick! Voraussetzung für die Nachstabilisierung ist auch hier, dass ein Video vorliegt welches mit einer kurzen Shutterzeit aufgenommen worden ist bei abgeschalteter interner Stabilisierung der Sony ZV-1. Empfohlen wird von den Gyroflow-Entwicklern die Verwendung einer 90°( 1/100 sec)- oder sogar 45°(1/200 sec) - Verschlusszeit bei 25p-Aufnahmen um Artefakte zu vermeiden, wenn es um Stabilisierungen von Aufnahmen die stehend oder schwenkend aus dem Stand heraus aufgenommen werden. Wird gehend/schwebend in Vorwärtsbewegung gefilmt, dann ist es evtl. besser mit der kürzeren Verschlusszeiten aufzunehmen. Die Kantenschärfe wird dann besser Kamera immer beidhändig führen und sich vorwäts in kleinen Schritten bewegen. Man sollte immer in der Original-Aufnahmeauflösung nachstabilisieren. Vorteilhaft ist es ferner für die Nachstabilisierung mit dem Ulanzi 18mm WW-Vorsatz zu flmen. Sollte es bei kürzeren Verschlußzeiten nach der Nachstabililisierung mit Gyroflow kommen, zu sichtbaren Wiedergabe- Rucklern kommen, dann hilft dagegen das das programminterne "Motion Blur" in Davinci Resolve oder ein externes Tool. Installationsanleitung/Bedienung: Ordungsgemäßer Platz für Gyroflow im OFX-Windowsverzeichnis:  Mit Gyroflow im EDIT-Arbeisraum arbeiten:  Gyroflow aus dem Warp-Effektverzeichnis wird mit der Maus auf den zu stabilisierenden "Wackel-Videoclip" in der Timeline aufgelegt. Im Inspector des Edit-Arbeitsraumes wird nun "Load for current file" geklickt um das File zu laden. Ganz wichtig ist es per "Load preset/lens profile" das Objektiv Profil zu laden. Für die Sony ZV-1 kann man die Objektiv-Profile ebenfalls von der Gyroflow-Homepage laden.   Vor dem Export muss man "Stabilization overview" deaktivieren laut Gyroflow-Hersteller

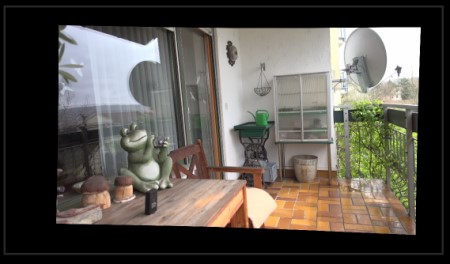

Nun stellt man die "Adjust parameters" ein. In die Einzelheiten muss man sich selbst einarbeiten, siehe hier: KLick! Das im DVR-Player angezeigte Videobild wird meist zunächst verkleinert dort angezeigt.  OFX-Gyroflow-Plugin bei der Zuschnitthersstellung im DVR-Player.

Player Anzeige per "Stabilization overview" aktiv oder inaktiv, hier sieht man den Crop bei der Nachstabilisierung. Wahlweise kann man Gyroflow auch im Color-Arbeitsraum auf einen Node setzen:

Die wichtigsten Einstellparameter für das Videobeispiel unten Wichtigste Einstell-Parameter:

Gyro-Nachstabilisierung per DaVinci Resolve Studio mit dem Geroflow Plug-in Gyroflow stabilisiert gehend aufgenommene UHD-Szenen mit meiner Sony ZV-1 sehr gut. Das

bei der Stabilisierung eingezoomt werden muss stört mich nicht. Ich

exportiere die stabilisierten Videos in der Auflösung von 2720 x

1530-25p kodiert in DNxHD HQ und füge es in mein finales FHD Projekt

mit der Auflösung von 1920 x1080-25p hinzu. Mit dem eGimbal Zhiyun CRANE M2 bin ich auf

Reisetouren nie mehr unterwegs, weil man mit einer solchen Ausstattung zu sehr auffällt. Mehr über die Installation des Plug-in und die Parameter-Anpassung siehe hier: KLick! Tipp: Next Level Videostabilisierung auch in DaVinci Resolve: Klick! Brandon Li: A New Way to Stabilize Your Handheld Footage Perfectly [Gyroflow free plugin]: Klick! +++

Benötigt man eine spezielle EDIT-Tastatur? Diese Frage hat ein Film- und TV-Kameraman so beatwortet: Klick! "Insgesamt ist der Speed Editor ein sehr solides, sinnvolles und gut gestaltetes Produkt, das dennoch aus keinem Schnittanfänger einen Oscar-Preisträger formt." Es ist etwas für Schnittanfänger, die nicht mit Maus und Tastaturbefehlen umgehen können, nicht für Berufsanwender. Info über Blackmagic EDIT-Tastaturen: Klick! Voraussetzung für den schnellen Videoschnitt und Aufbau einer Story:

Mit JKL kann man mit dem Timeline-Cursor sich nach links oder rechts bewegen in verschiedenen Geschwindigkeiten je nach dem wie oft man J(links abspielen) oder L(rechts abspielen) betätigt. Mit K kann man die Bewegung stoppen. Tipps um 3x schneller zu schneiden: Klick! Viel mehr Tastaturkürzel findet man hier im deutschsprachigen DaVinci Resolve Forum: Klick! SuperScale gegen Topaz AI, was ist besser? Es kommt bei mir immer wieder mal vor, dass ich Videos auf 720-25p hochskalieren muss. Habe das immer mit SuperScale durchgeführt und war zufrieden damit. Seit der Version 18.5 arbeitet Superscale mit KI-Technologie(ab 17:45 in der Videopräsentation): Klick!  Frank Glencair hat einen Test durchgeführt der belegt, dass es Topaz AI in den meisten Fällen nicht besser kann. Die Renderzeit ist im Falle Topaz AI um den Faktor 8 länger. Die Warterei auf das Ergebnis lohnt sich nicht, die Investition in das Topaz Plug-in lohnt sich dann erst recht nicht: Quelle: Klick! Ich setze Super Scale "2x Enchanced" z.B. dafür ein um aus VHS-Analogvideos(Auflösung etwa 320x 240 Pixel) die in einer Auflösung von 720 x 576-25p in 4:3 mit EDIUS 9 - Lanczos 3 Filter(hohe Qualität) digitalisiert worden sind um mittels Hoch-Skalierung die Auflösung auf 1280 x 720-25p Videoformat mit schwarzen Balken links und rechts zu bringen. Wichtig ist es, in der Projekteinstellung das Exportformat 1280 x 720-25p und 8bit als erstes einzustellen. Im Montage-Arbeitsraum wird dann im Inspector Super Scale auf "2x Enchanced" aktiviert. Im Export-Arbeitsraum kann man dann die Timeline z.B. in MP4(H.264) exportieren.  Szenen-Frame "Schmetterling"

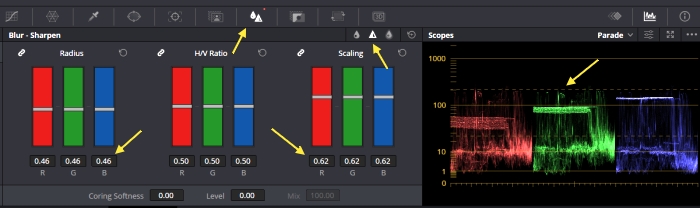

VHS in 1280 x 720-25p mit Super Scale "2x Enchanced" mit schwarzen Balken links und rechts damit kein Bildinhalt des 4:3 Videos verloren geht. Der PC benötigt allerdings sehr viel Zeit um das alles zu berechnen. Es kommt vor allem auf die Leistungsfähigkeit der GPU an. Meine NVIDIA-Grafikkarte schafft gerade mal eine Skalierungs-Kodierung bei "2x Enchanced" mit 1,5 FPS, die Kodierzeit für eine Minuten Original Video beträgt etwa 20 Minuten. Geht es auch schneller? Natürlich geht das, z.B. in Super Scale 2x, also ohne Enchancer. In diesem Fall kodiert das mein Rechner mit 21 FPS, die Kodierzeit beträgt in diesem Fall für eine Minute Originalvideo nur 1,2 Minuten. Evtl nötige Nachschärfung, Entrauschung und Belichtungskorrektur mache ich manuell mit dem normalen Werkzeug in DaVinci Resolve. Ich erkenne keine großen Nachteile, da der Betrachtungsabstand zum 55" LG OLED HDR-TV ca. 3,5m beträgt. Bei UHD-Auglösung(3840 x 2160) müßte der Betrachtungsabstand unter 2,1m bleiben um mehr Details zu erkennen laut dem Hersteller LG und genau das in unserem Wohnzimmer nicht praktikabel. Zur Erinnerung, ein VHS-Video hatte nur eine "Auflösung" von etwa 320x 240 Pixel. Um mehr für "2x Enchanced" zu bekommen benötigt man eine deutlich leistungsstärkere NVidia-Grafikkarte die auch mehr Strom benötigt was u.U. ein neues Netzteil erfordert. In diesem Fall mus man dann im Bios "Resize Bar" aktivieren um die benötigte Leistung der GraKa freizusetzen, siehe: Klick! Aktiviert man dann in der NVIDIA-Systemsteuerung, unter Hilfe die "Systeminformationen" an, dann bekommt man dort den Status der "Resizable Bar Anzeige" zu Gesicht mit "Ja" wenn diese Option eingeschaltet ist. Mehr Informationen findet man hier: Klick! Eine Echzeitwiedergabe ist in meinem Fall nicht möglich, siehe z.B. Anzeige in GPU-Z:  Internet-Nachforschung haben ergeben, dass es resizable Bar im BIOS erst ab Beginn der Vermarktung von NVIdia RTX 30... gibt. Störendes Objekt entfernen: Es kommt vor, dass man störendes Objekt aus dem Videobild entfernen möchte. Das geeignete Werkzeug dafür nennt sich Object Removal FX. Ein einfaches Video-Tutorial dafür wird hier angeboten: Klick! Der beste Zeitlupen-Algorithmus: Das geeignetste Werkzeug dafür nennt sich Speed-Warp KI, Siehe fogendes Video-Tutorial: Klick! Butterweiche Zeitlupe selbst mit 24p Aufnahme: Klick! Bewegungsunschärfe und lokales Flimmern: Bewegungsunschärfe: Wenn man zu schnell während der Videoaufnahme schwenkt, wird bei feinen Videobildstrukturen wie Dachziegeldächern, im Astwerk in Sträuchern/Bäumen, Fensterjalousien etc. Bewegungflimmern und starke Unschätfe entstehen. Unter Umständen bekommt man das während des Videoschnitts nicht mehr weg. Das muss man schon bei der Aufnahme berücksichtigen, d.h. UHD-Schwenks viel langsamer durchführen als man das noch von der SDR-Aufnahme her gewohnt war, sonst wird die Schwenkpassage über die ganze Zeit unscharf bleiben und der Zuschauer wird wegen dem Nachziehschweif dadurch verärgert. Flimmern: Bei meinen UHD-Aufnahmen stelle ich in den PP(Bildprofilen) die Details auf -7 ein, d.h. die Nachschärfung ist bei der Kameraaufnahme abgeschaltet. Die Nachschärfung erfolgt in der Videonachbehandlung. Dabei kann lokales Flimmern während der Wiedergabe entstehen falls man es mit der Nachschärfung übertreibt. Neben

der Nachschärfung per "FX Sharpen

Filter" bietet DaVinci Resolve noch

andere, sogar wirkungsvollere Nachschärfemöglichkeiten. Eine Option ist

der Einsatz des "Midtone Details"

mit einem Regler und das "Blur-Sharpen"

mit den zwei vertikalen Reglern.

Blur-Sharpen

einstellen Die Stellung der beiden Regler [Radius] und [Scaling] entscheidet ob das Flimmern aufkommt oder nicht.

Bei diesem Frame-Aussschnitt habe ich das aufkommende Flimern mit folgenden Reglerwerten verhindert: Radius 0,47 und Scaling 0,35; schiebt man den Scaling-Regler höher, fängt das Videobild an zu Flimmern. Einstellkontrolle im Highlight-Difference-Mode: Um die Nachärfung oder auch Entrauschung besser bewerten zu können, kann man im Color-Arbeitsraum per Split-Screen die Highlight-Modes zuschalten. Für diesen Vorgang muss das Caching und der Cache im Menü Playback abgeschaltet werden.

Man bekommt dann im geviertelten DaVinci-Player

das Input-Bild links oben, die eingestellte Kanten- und Detailmenge

links unten sowie das Output-Farbbild rechts oben angezeigt.

Ich kontrolliere das dann immer auf dem 32"- HDR-TV, der über eine Blackmagic Intensity I/O-Videokarte am PC angeschlossen ist. Zunächst kontrolliere ich das alles im geviertelten Bild und dann nochmal in der Vollauflösung des TVs am Schnittplatz. Es soll ja kein Flimmen aus Überschärfung etc. im finalen Video vorhanden sein. Tipp: Die besten Möglichkeiten der

Nachschärfung bietet DaVinci Resolve hier an: Klick! Tipp: Edge Effects(Kantenanhebung für Scharfzeichnung oder Halo-Effekte, siehen Seite 3376 der Bedienungsanleitung): Klick!

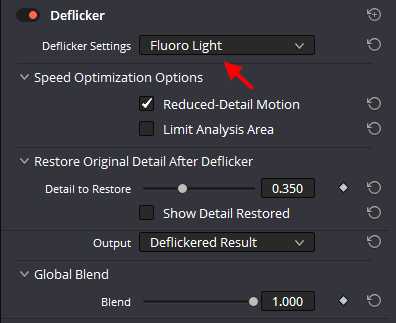

Bild: Aus Blackmagic-Werbung Der H.264 Codec zum Beispiel zeichnet eine Gruppe von Bildern auf und produziert hierbei das GOP-Flickerung, manchmal als rhytmisches oder schimmerndes Muster bei ein Schwenk über filigrane Objektstrukturen. Bei 25p-Aufnahmen ist das erste Frame am schärfsten. Die nächten 24 Frames sind komprimierter, jede Sekunde flackert es dann. Mit dem Deflicker-Filter "Fluoro" kann man das Problem beseitigen.  Deflicker-Einstellungen:

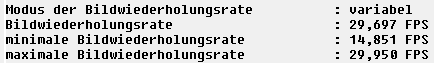

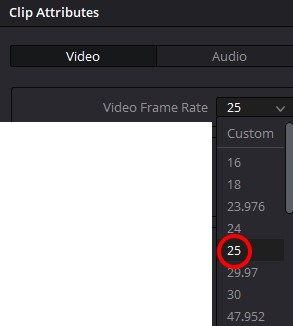

Bei dem Setting „Fluoro Light“ handelt es sich um Presets zum Entfernen von zwei unterschiedlichen Flimmerartefakten. Sollten das Deflicker Setting nicht so wirksam wie erhofft sein, bekommt man unter „Advanced Controls“ an dieser Stelle weitere Optionen namens „Isolate Flicker“ angeboten, die im Zentrum des Plug-ins stehen. Sie ermöglichen Feinanpassungen nach Maß. Tipp: Klick! Smartphone VFR-Frameraten im DaVinci Projekt anpassen: Meine Videos werden aus DaVinci heraus in 25p exportiert. Die Sony ZV-1 liefert 25p Videoclips die kene Probleme verursachen. Ein Problem sind dagegen die Videos aus dem Smartphone Huawei Mate 20 Pro, diese werden mit einer variablen Videobildrate(VFR) geliefert, z.B. so:  Diese VFR-Bildrate muss auf CBR 25p-Timeline angepasst werden, wobei der Ton entfernt wird, das Video sollte aber möglichst ruckelfrei abgespielt werden. Auch wenn man per HandBrake mit Neukodierung von VFR auf CFR umrechnet, kann das Vdeo an manchen Stellen noch ruckeln. In DaVinci Resolve 18 Studio stellt man im Media-Pool bei den Attributen(Eigenschaften) auf 25p.  Die Methode "Nearest/Frame Blend/Optical Flow" findet man im Arbeitsraum EDIT/Retime and Scaling/Retime Process:

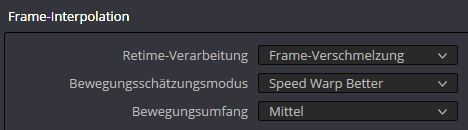

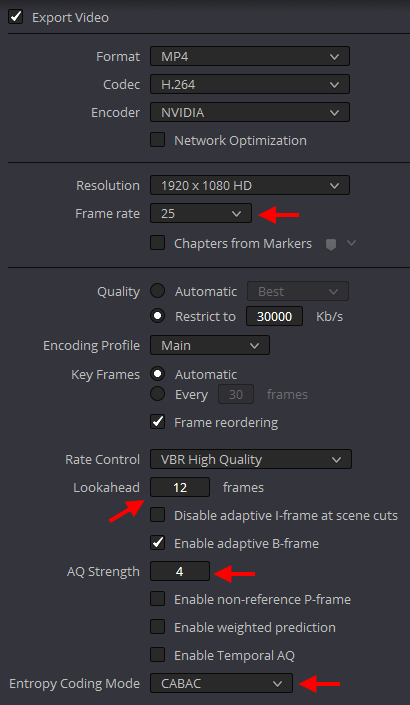

In Projekteinstellungen/Mastereinstellungen; findet man die Methode "Frame-Interpolation" zu finden:  Die Schlüsselrolle spielt hier "Speed Warp Better". Im Falle von VFR-Framebildraten aus der Kamera heraus sind hiermit beste Ergebnisse in DaVinci zu erwarten. Diese Methode benötigt mehr Prozessorleistung. Nützlich ist noch eine zusätzliche Videostabilisierung als Glättung bei dem Abspielen des Video-Clips. Sollte das Videobild etwas flackern während des Abspielens, kann man noch zusätzlich den Deflicker drauflegen. Siehe auch: Mixing Frame Rates in DaVinci Resolve – Part 1-5: Klick! Normales SDR-Projekt in Full-HD anlegen, bearbeiten und exportieren: Mit SDR-Videomaterial kann man viel einfacher in der Nchbearbeitung umgehen als z.B. mit HDR- oder Log-Videomaterial. Auch der Geräteparkt ist nicht besonders anspruchsvoll, man benötigt keine HDR-Videokamera für die Aufnahme und kein HDR-Wiedergabegerät dafür. Das können Videoaufnahmen vom Smartphone, GoPro Hero 7 oder DJI-Pocket 2 in meinem Fall sein. Man muss hier lediglich darauf achten, in welcher Bildwiederholrate die Aufnahmen erfolgt sind, also 29,97 oder 25 oder 50p. Aufnahmen von Smartphones sind meist in einer variablen Bildwiederholrate aufgenommen was Problemen bei der Wiedergabe führen kann. Wie man dem begegnet habe ich schon hier beschrieben: Klick!  Die programmeigene Stabilisierung in DaVinci Resolve beruhigt nicht übertriebene Wackel- und Zittervideos problemlos. Bei der Bearbeitung im Color- Arbeitsraum muss man keine "Geschütze" auffahren, meist reicht es mit Kurven, die Farbe und den Kontrast in einem Videoclip anzupassen. Full-HD SDR-Export-Setting z.B. in MP4/H.264:

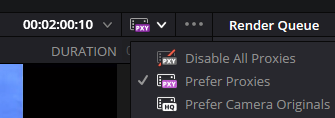

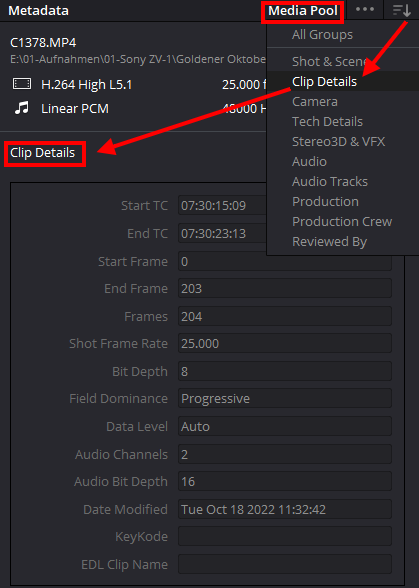

Falls der Export in MP4/H.264 nicht per DaVinci Resolve erfolgen soll, sondern z.B. mit Handbrage, Edius, etc, dann kann man eine Intraframe-Kodierung aus DVR heraus machen in Cineform 10bit, DNxHR HQX 10bit oder GV-HQX 10bit.  Anzeige im DaVinci Player, ich bevorzuge "Prefer Camera Originals" Clipdetails der im Mediapool abgelegten Videoclips ansehen: DaVinci Resolve bietet zwar eine große Auswahl von Metadaten die aus den Clips im Mediapool angezeigt werden können, nicht aber den Farbraum an der mit meine Sony ZV-1 aufgenommen hat, was bei HDR-Projekten wichtig ist.  Man muss ersatzweise auf ein Hilfs-Tool zurückgreifen, in meinem Fall auf "Media Info".

Mit Intel-GPU und/oder NVidia-GPU? "Optimized Media" ist bei mir derzeit nicht aktiviert, "Timeline Resolution" steht bei mir auf "Full", "Render Cache" steht auf "None", Ich editiere mein eigenes Videomaterial ohne "Proxy". Weitere Reserven für höhere Timelinelast sind also zusätzlich noch aktivierbar. Tutorial - DaVinci Resolve schneller machen: Klick! PugetBench für DaVinci Resolve: Klick! GPU-Module in meinem Videischnitt-PC:  Für DaVinci Resolve verfügbare Grafik-Einheiten

im Geräte-Manager DaVinci Resolve Systemanforderungen und Benchmarks: Klick! Der Leistungszuwachs für zwei identische NVidia RTX-Grafikkarten kann bis zu 50% betragen, wenn bauliche Voraussetzungen, wie zwei Grafikkartenslots mit Grafikkarten-Management auf dem Motherboards und ein leistungsstarkes Netzteil sowie ausreichende Kühlung vorhanden sind. Die Stromrechnung wird höher! CPU- und GPU-Rendering: Was ist besser, Klick! DaVinci Resolve nutzt die in meinem PC vorhandenen unterschiedlichen Grafikeinheiten für zwei verschiedene Zwecke:

Information zum Intel Performance Guide: Klick! Die

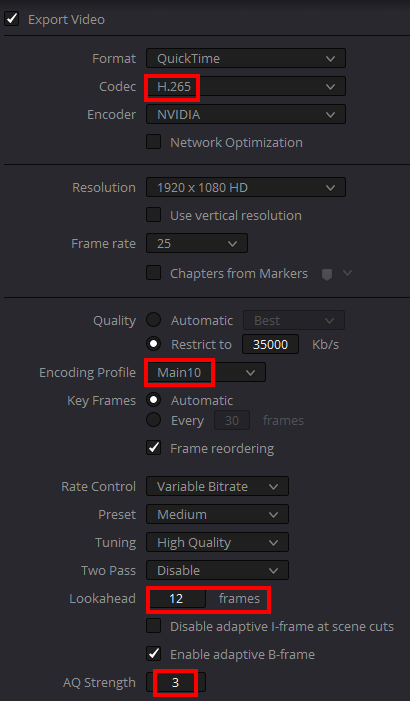

am häufigsten im Hobbyfimerbereich eingesetzten Encoder wie MP4, H.264,

H.265, VP9, oder HEVC werden mit den optionalen Einstellungen ab Seite

4046 des Delivery Manuals beschrieben.

Sehr gute Exportergebnisse bekommt man mit dem kostenlosen Voukoder.

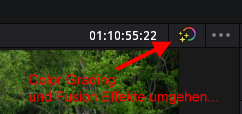

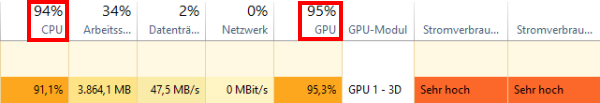

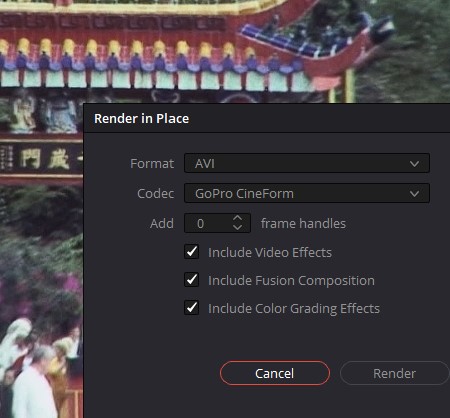

In der NVIDIA-Systemsteuerung müssen die 3D-Einstellungen der CUDA-GPUs auf "Alle" aktiviert sein!  Wichtig: ist die Timeline mit FX-Filtern zu stark belastet, kann man u.U. nicht mehr flüssig editieren. In diesem Fall kann man diese Timeline-Last temporär abschalten.  Ab- und Zuschaltung der Timelinebelastung über dem Player-Windows. Vor dem finalen Rendern kann man die Effekte wieder zuschalten. In einem BM-Community Beitrag geht es um die Frage wie die Hardwareeinstellungen mit hoher Filterlast auf der Timeline am besten einzustellen sind damit der PC am schnellsten final rendert und nicht in der Verarbeitungsgeschwindigkeit einbricht. Der Task-Manager zeigt die Auslastung des aktiven GPU-Moduls und der CPU bei dem finalen Rendern(Deliver) mit den unten gezeigten Korrektur-Nodes im Color-Arbeitsraum:  Die höchste Auslastung der CPU und GPU(beide nahe 100%) erzielt man mit dem von BM nicht gelieferten Voukoder. Die Besonderheit im Voukoder ist die Option einer Kodierung mit der x264-Bibliothek, wie per HandBrake. Mit dem Voukoder erzielt man bessere Ergebnisse als mit der standardmäßigen DaVinci Resolve Auswahl per MP4, H.264, H.265, VP9, oder HEVC bietet.  Resolve erfordert viel GPU-VRAM(Grafikspeicher der Grafikkarte) für temporale Effekte (alle Versionen) Aktuelle Versionen von DaVinci Resolve sind sehr anspruchsvoll, wenn es um die GPU-Speicherressourcen geht, insbesondere wenn Temporal Noise Reduction (ein integrierter Filter in Resolve) oder OFX-Plug-Ins von Drittanbietern verwendet werden, die eine zeitliche Verarbeitung durchführen (wie Neat Video). Dies kann zu einem Problem werden, wenn Sie mit großen Auflösungen wie 4K und größer arbeiten. Für 4K-Timelines benötigt Resolve offiziell mindestens 8 GB GPU-Speicher (auf einer GPU!). Bei Resolve kann es zu einem Mangel an GPU-Speicher kommen, selbst wenn diese Anforderungen erfüllt sind und insbesondere, wenn sie von der Hardware nicht erfüllt werden. In diesem Fall zeigt Resolve eine Fehlermeldung an: "Ihr GPU-Speicher ist voll. Versuchen Sie, die Zeitachsenauflösung zu reduzieren ..." schreibt der Support von Neat Video. Quelle hierzu: Klick! Beispiel für eine höhere Timeline-Belastung bei einer Restaurierung mit hauseigenen DaVinci-Filtern auf den Nodes:  Insgesamt ist hier die fünf Minuten-Timeline 1920 x 1080-25p(Grass Valley HQ-AVI) mit fünf Nodes belastet: Belastung mit Node 2 bis 5: Rendertempo 41,5 FPS also mehr als Echtlaufzeit Belastung mit Node 2 bis 6: Rendertempo 23,5 FPS, fast Echtlaufzeit Damit bin ich durchaus für diesen Fall zufrieden. Slashcam-Beitrag: Klick! Wenn der Rechner eine derartige Filterlast auf bestimmten Clips nur noch ruckeln darstellen kann, dann aktiviert man diesen in der Timeline, dann Maus-Rechtsklick auf den Clip und aus dem aufgegangenen Kontexmenü "Render in Place" wählen und z.B. so einstellen:   Render in Place Ergebnis

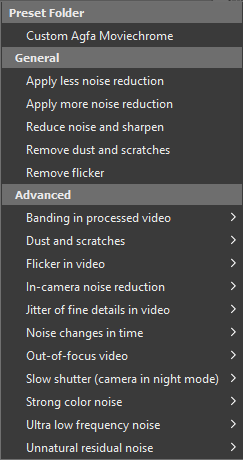

Man bekommt so einen flüssig ablaufenden Clip, dem man noch andere Eigenschaften hinzufügen kann wie z.B. Text oder Audio. Jetzt kann man alles problemlos final per Deliver kodieren in ein komprimiertes Format wie z.B. mp4/mp5. YT-Tutorial - Render in Place: Klick! YT-Tutorial - Export und Rendersettings: Klick! Zusatz-Tool, der Shutter Encoder: Es handelt sich um einen Konverter der von Video-Edtoren entwickelt worden ist. Klick! Shutter Encoder ist einer der besten Videokomverter, er verarbeitet auch Bilder und Audio! Neat Video Plug-in V5 für DaVinci Resolve Studio: Für die "Flicker Reduzierung" gibt es die neue Wunderwaffe Neat-Video als DaVinci Resolve-Plug-in: Klick! Dieses vielseitige Plug-in sollte man unbedingt besitzen, wenn man auf dem Niveau von DaVinci Resolve Studio arbeitet.  Benutzerdefinierte Funktionen Presets lassen sich abspeichern! Über die Verkürzung der Renderzeiten bei Nutzung von "NeatVideo Plug-in" findet man hier etwas über die optimale Performance: Klick! Interlaced-Video in DaVinci Reolve bearbeiten, siehe: Klick! Tipp: Neat Video als Anti-Banding Filter einsetzen: Klick!"Flimmern" reduzieren mit Neat Video: Klick! Beseitigung verschiedener Störungen nach Film- und Videostabilisierungen: Klick! Weitere Videotutorials für Neat Video: Klick! Cleaner Video: Klick! Korrektur-Profile für Fehlerbeseitigung finden: Klick! Der Support des Herstellers von Neat Video hat hier eine Resolve-Problembeschreibung zusammengestellt: Klick! Vorschaurendern(Playback) per Render-Cash auf "User": Test-Video

UHD-25p(8Bit, BT.2020) mit 100 fps in einer FHD-Timeline FHD-25p mit

einer Real-Laufzeit von 11 sec.per Playback der Render-Cash auf "User" in Echtzeit durch, also 11 Sec im Falle Neat Video v5. Beste Möglichkeiten zur Reduzierung von Videorauschen in Davinci Resolve: Klick! Update auf NeatVideo V6.0.4 Home* am 10.04.2025:  * da ich mit einer 1920 x 1080 Timeline mit Ausschnitten aus 4k-Aufnahmen arbeite, siehe auch: Klick!  Enormer Speed-Zuwachs per GPU Im "Farbe-Arbeitsraum" wird Neat Video auf den ersten Node gesetzt. Im Montage-Arbeitsraum kann man per Kontexmenü die Option "Vor Ort rendern..." aktivieren wodurch die Vorschau vorgerendert wird für einen flüssigen Lauf.  Umfangreiche Help-Optionen Neat Demo Video

Wirkung der programmeigenen DaVinci Resolve Entrauschung: Es fällt einem zunächst garnicht auf, dass ein Entrauschungs-Werkzeug im Color-Arbeitsraum vorhanden ist. Im Gegensatz zu "NeatVideo" benötigt man in DaVinci enthaltene Entrauschungsfunktion im Color-Arbeitsraum kein Kamera-Rauschprofil, das kann in machen Fällen wo es im Clip keine homogene Rauschfläche ohne störender Objekte darin gibt ein Vorteil sein: Die Einstellungen nimmt man in Temporal NR und Spatial NR im Color-Arbeitsraum vor... Temporal NR

wird von Fachleuten höher geschätzt weil in diesem Fall auch die

Zeitachse(Motion-Wert) mit einbezogen wird. Mit den nachfolgenden

Frames. Spatial NR greift dagen sehr stark ein ohne Berücksichtigung der Zeitachse.

Ganz

wichtig ist es die Wirkung der Einstellungsparameter in der

Vollbildvorschau auf dem zweiten Display - bei mir ein HDTV - zu

kontrollieren. Es wird empfohlen die Entrauschung nacheinander also zuerst "Temporal", dann "Spatial" durchzuführen. DaVinci

Resolve Studio arbeitet bei der Entrauschung hier in Echtzeit, sind

jedoch weitere Nodes mit Filtern belegt bricht die Echtzeitverarbeitung

ein, der Vorgang sollte deshalb am Ende der Nachbbearbeitungskette

erfolgen, siehe: Klick! Man kann auch die Nachbearbeitung in einzelnen Filteretappen durchführen wenn man mit dem Zwischencodec Grass Valley-HQX arbeitet, in diesem Fall hat man in jeder Etappe eine verlustlose Zwischendatei bis zum finalen Export. Video-Tipp 1: Noise Reduction Tools and Techniques in DVR-Studio: Klick! Die bisherige Entrauschung in DVR - siehe oben - war nachbesserungsbedürftig, deshalb fügte amm 12.04.2024 Blackmagic das UltraNR als option dem Spatial RR hinzu. UltraNR ist ein neuer, von der DaVinci Neural Engine gepowerter Modus zur Rauschreduzierung, den man in der Palette für die räumliche Rauschreduzierung Spatiale RR des ColorArbeitsraumes findet. In diesem Modus kann man digitales Rauschen in einem Bild drastisch reduzieren, ohne die Klarheit zu beeinträchtigen. Für eine noch effektivere Rauschreduzierung in Aufnahmen mit Bewegung kombiniert man diesen Modus mit der zeitlichen Rauschreduzierung Temporale RR. Siehe auch: Klick!  Verrauschte Referenzstelle die von UltraNR automatisch gefunden worden ist: Man kann die Auswahlfläche zusätzlich noch manuell anpassen. Ich kontrolliere das auf dem neben dem PC-Monitor stehenden 32" HDR-TV der das TV-Signal von der Timeline mittels der Blackmagic Intensity 4K Pro I/O-Steckkarte geliefert bekommt.  Temporale RR und Spatiale RR Einstellungen  Luminanz Node(02) mit UltraNR Node(03) Das alles zusammen liefert eine gut entrauschte Nachtaufnahme ohne wabbernder Pixelwolken. Es muss jetzt nicht unbedingt mit Neat Video entrauscht werden. Wenn es an Echtzeitperformance des Videoschnitt-PCs bei der vollauflösenden Vorschau mangelt muss man für die Wiedergabe im Menü "Wiedergeben" entsprechende Einstellungen vornehmen, z.B. den Render-Cash auf "Intelligent" einstellen und dann die Wiedergabe so lange in der Schleife laufen lassen bis durch den "Lerneffekt" oberhalb des Videoclips eine blaue Linie erscheint als Zeichen für die Echtzeitwiedergabe. Neu in V18: Chromatische Aberration entfernen: Es handelt es sich bei chromatischen Aberrationen um Farbsäume, die beim Fotografieren/Videofilmen vor allem an Rändern und Kanten im Bild auftreten. Bei sehr kontrastreichen Stellen im Bild (hell / dunkel) treten CAs besonders häufig auf! Als beste Entfernungs-Methode für Farbsäume galt bisher meiner Meinung nach das folgende Workflow-Tutorial: Klick!  Zoom-Bildausschnitt: CA zum obigen Tutorial Bei dieser Gelegenheit: Wie man einen Zoom-Bildausschnitt im DaVinci Player vergrößert und verschiebt?

Mehr dazu ab Seite 3345 der Bedienungsanleitung Erweiterte

Optionen wie "Stronger Correction", "Lens Center X/Y" sowie "Show

Estimated Fringes" bieten strengere zusätzliche Parameter für

problematische Aufnahmen um Chromatische Aberrationen oder Farbsäumen

zu entfernen.. Wikipedia:

Klick!

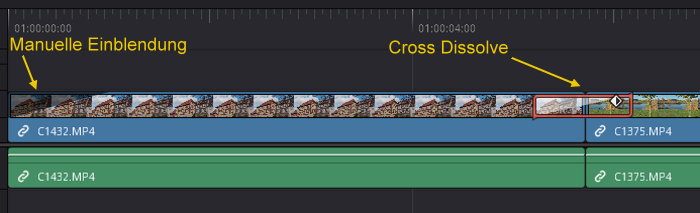

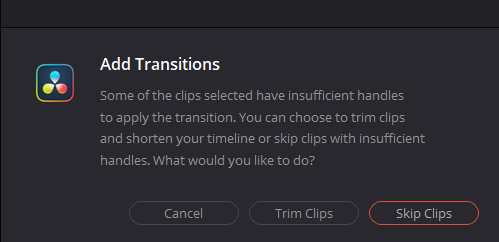

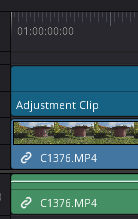

Bildbereiche in der Postproduktion neu auszuleuchten: Dafür gibt es verschiedene Methoden, ich stelle hier zwei davon vor, die mir schon geholfen haben: Methode 1(Müller): Klick! Methode 2(Muentermedia): Klick! Story entwickeln und Feinschnitt durchführen in Da Vinci Resolve: In DaVinci Resolve kann man den Feinschnitt mit harten Schnitten oder einer manuellen Clipeinblendung oder einer Transitions(z.B. Cross Dissolve) durchführen um z. B. zwei Szenen miteinander zu verbindet.  Transitions werden auf die Schnittmarke abgelegt  Hinweis, dass an der Schnittstelle nicht genug Material(Handles) für die Überblendung vorhanden ist und deshalb die Abspiellänge der betroffenen Clips automatisch mittels "Trim Clips" gekürzt wird. "Adjustment Clip" vereinfacht Editiervorgänge Mit Adjustment Clips kann man verschiedene Editiervorgänge vereinfachen, wie z.B.:

In den Videotutorials wird anschaulich gezeigt wie man die Aufgaben sehr einfach lösen kann in dem man eine "Einstellungsebene" schafft die über der zu behandelnden Szene als "Adjustment Clips" liegt.  Der "Adjustment Clip"

überträgt Informationen von oben,

wie z.B. Farbraum-Transformationen und andere Effekte auf die darunter liegende Videoszene  Beispiel: SDR-Transfom Frame aus

HLG3

Konsistenten Farb-Look der Clips untereinander herstellen: Von Version zu Version

baut das Kreativteam von Blackmagic immer wieder neue Funktionen oder

Abläufe ein. Arbeitsweise um

einen konsistenten Look zu erzielen: Klick! Habe einen tiefgreifenden Überblick über die Möglichkeiten den Look mehrere Clips anzugleichen mit Hilfe des obigen Videos bekommen. Das sollte immer an erster Stelle im Color-Arbeitsraum erfolgen. DaVinci-Resolve verfügt über einzigartige Funktionen und Werkzeuge um den Look-Abgleich zu kontrollieren. Interessante Abschnitte im obigen Video Tutorial: #1 bei

ca. 1:13: Clips Timeline im

Color-Arbeitsraum Beispiel: 5 Videoclips die farblich

aufeinander abzustimmen sind

In der Lichtbox kann ich die

Farbunterschiede auf meinem 32" LG-Monitor sehr gut beurteilen

Gröbere

Abgleichoption: Abgleich vom Clip 2 mit dem

Video zum Color-Arbeitsraum: Klick! LUTs richtig anwenden: Klick! Arbeiten mit Farbton vs. Kurven in DaVinci Resolve: Klick! Video-Tutorial: Navigieren in den Grundlagen von Farbrädern: Klick! Abgleich mit Split Screen, horizontal,

vertikal, diagonal etc. möglich  Abgleich mit selektierten Clips im

Playerfenster(Selected Clips)

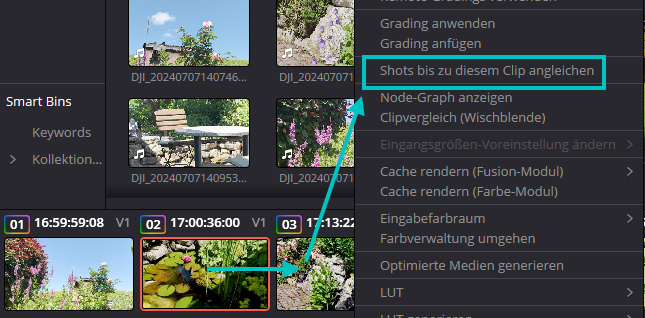

Shots bis zu diesem Clip abgleichen:  Im Farbe-Arbeitsraum Clip anklicken von dem aus die Farb- und Kontrasübertragung stattfinden soll. Jetzt den daneben liegenden Clip mit der rechten Maustaste anklicken. Es geht ein Kontexmenü auf im dem man nun "Shots bis zu diesem Clip abgleichen" betätigt. Globale Übersicht wie man eine Farbkorrektur von Sony S-log3 und HLG in Davinci Resolve durchführt: Link zu Elemente des Filmemachens: Klick Hiermit lernt man sehr viel über die Farbkorrektur, wenn man die Beispiele durcharbeitet. Filmt man z.B. in S-log dann bringt man das Videomaterial zuerst per "Colorspace Transform" in einen größeren neutralen Farbraum, dann erfolgt die Farbkorrektur, z.B. auch mit einer LUT die aber nur auf die Farbe wirkt. Abschliessend folgt das Grading mit dem Zielfarbraum und Gamma. D.h. die LUT ist neutral, und nicht Kamera/Gamma spezifisch - daher meine Frage (vielleicht hast du ja besondere Gründe). Man unterscheidet zwischen verschiedenen LUTs: Bei der Kamera-Aufnahme mit meiner Sony ZV-1 nutze ich das Video Assist-Display um schon vor der Aufnahme besser die Belichtung/Farbstimmung kontrollieren zu können je nach dem ob man in HLG oder S-Log in XAVC S 100M aufnimmt.  Assist HLG2020 auf dem Kameradisplay der Sony ZV-1 Es gibt LUTs im Netz die kostenlos und kostenpflichtig erworben werden können.

Bildvorlage Linear/Cineon LUT-Stresstess

um die Wirkung auf

einem HDR-TV am Schnittplatz zu bewerten. Die 17 Point Cube LUT wird meistens bei dem Feld-Monitoring der Kamera-Aufnahme eingesetzt. Die 33 Point Cube LUT ist für das Color-Grading unserer Hobbyfilme gut geeignet. Die 65 Point Cube LUT wird auf einfacheren Wiedergabe-Panels kaum als verbessertes Ergebnis wahrnehmbar. Es gibt nützliche und unnütze LUTs, manche LUTs können sogar das Bild zerstören oder Details verschwinden lassen. Man sollte deshalb bei der LUT-Auswahl mit Bedacht umgehen. Vom Node zum LUT-Angebot

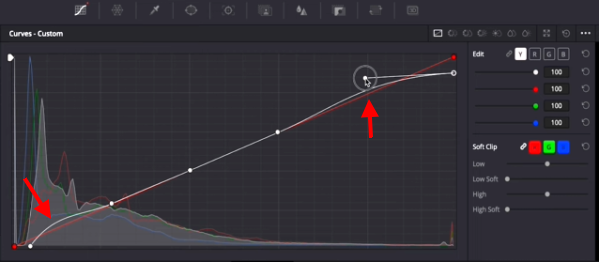

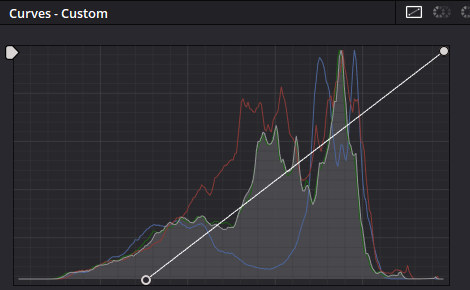

Tabellarische LUT-Auswahl Mehr als modische Looks: Klick! Anwendung von LUTs: Klick! Test-Bild für LUT-Stresstest: Klick! Installieren von Windows ICC-Profilen: Klick! Nach der Vorschau der fünf Videoclips kann man im Color-Arbeitsraum noch weitere feinere Abstimmungen im zusätzlichen Node mit der primären Farbkorrektur z.B. vornehmen. Ich arbeite dabei am liebsten mit den Curves. Curves . Custom:

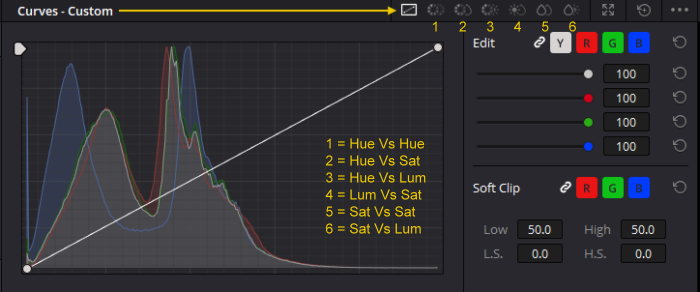

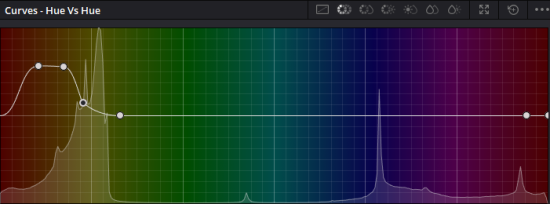

Curves mit sechs verschiedenen erweiterten Werkzeugen.

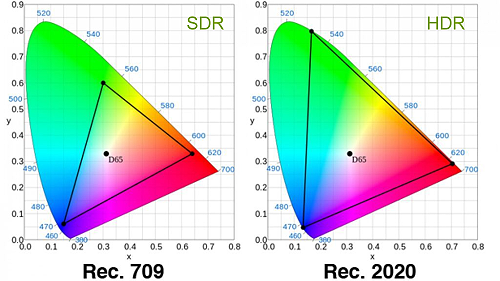

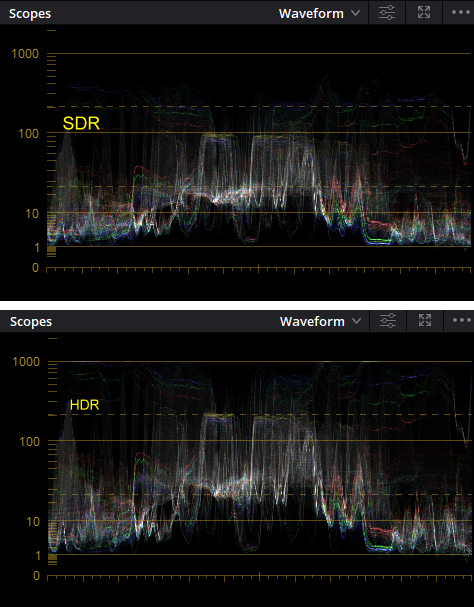

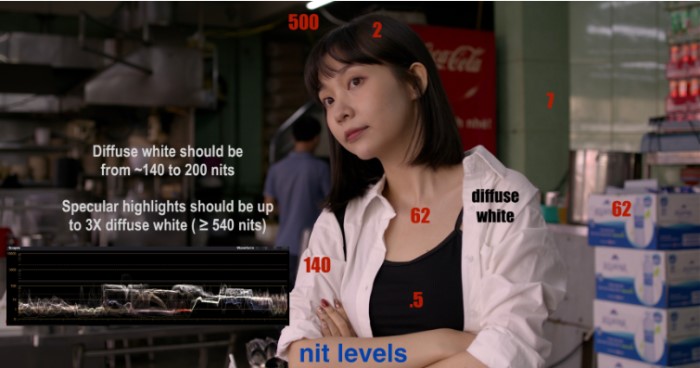

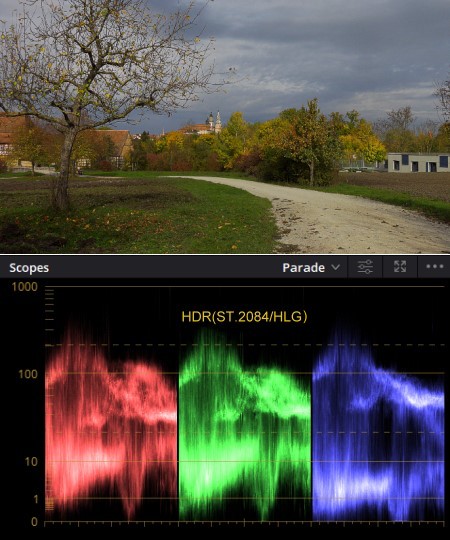

Luminanz - Kompression: Wenn das Video "filmischer" aussehen solll... In diesem Fall ändern wir die Luminanz in den Schatten und Lichtern nur partiell. Chroma bleibt unberührt.  YT-Tutorial: Klick! Mein aktueller HDR-Workflow: Wenn man über Grundkenntnisse zum Videoschnitt mit DaVinci Resolve verfügt, kann man sich auch an spezielle Projekte - wie z.B. HDR-Videoschnitt - heranwagen. Hier und da bekommt man erweiterte Kenntnisse mit Hilfe von Text- und Video-Tutorials die man mittels der Suchfunktion in Google finden kann. Siehe auch: Klick! Mehr Freude an den Videoaufnahmen wegen mehr Wiedergabe-Kontrast = größerer Dynamikumfang für bessere Wiedergabe mit detailreichen Glanzlichtern. Eine hohe Auflösung allein ist nicht = HDR - es geht vor allem um gute Kontraste. Bei dem Analogfilm waren die Aufnahmen waren viel softer und der Kontrast je nach Verfahren deutlich härter. Heute kann man dank HDR auch in den Schatten reiche Differnzierungen herausarbeiten, das war beim Analogen Film nur durch Tricks wie Vorbelichtung machbar. Nach dem Videoschnitt wird das Videomaterial zuerst einer Farbkorrektur unterzogen, es folgt dann das Color Grading siehe: Klick! und hier: Klick! Was ist HDR: Klick! Was ist HDR (High Dynamic Range)? - Profi-Meinung von Alister Chapman: Klick! Für eine Testwiedergabe: Real 4K HDR -Planet Earth II HDR Review im MKV-Format: Klick! HLG3: ZV-1 8Bit und A7sIII 10Bit Aufnahmen, die ersten ca. drei Minuten sind mit der ZV-1 gefilmt worden: Klick! GRADING LEITLINIEN FÜR UHD HDR & SDR PRODUKTIONEN: Klick! Bei der Entwicklung meines persönlichen Workflows habe ich mich hauptsächlich auf praktikable Maßnahmen beschränkt die schnellst möglich ein abspielbares HDR-Video am Ende der Arbeitskette liefern um das Ergebnis auf den 55" LG-OLED HDR-TV mit Zufriedenheit betrachten zu können. Hier noch ein aktuelles Tutorial - Der ultimative HDR-Video Guide für YouTube & Resolve: Klick! Will man mehr, dann muss man auch mehr Geld in das "HDR-Videoabenteuer" investieren. Das will ich aber nicht... Die Daejeon-Chroniken, die Nr. 1 mit Infos über HDR: Klick! Daejeon Monster-Guide Teil I plus weitere Teile dazu: HDR10 in Resolve Studio 18: Klick! Das Aufnahme-Material meiner Kamera im HDR(HLG3) im Fabraum BT.2020 kann ich in DaVinci Resolve in HDR(HLG) oder HDR PQ exportieren. Die Einstellungen dafür erfolgen für den Export in den Projekteinstellungen, sowie in der Primären Farbkorrektur für den Export. Die NIT Level-Kontrolle erfolgt per "Videoscope" und per Augenschein auf einem "HDR-TV" auf dem Arbeitsplatz. HLG ist allerdings die einzige Möglichkeit ohne separaten SDR-Export ein HDR Video auf einem SDR Monitor anzuschauen. Mit PQ geht das nicht. Im Falle HLG stimmen die Signalkurven zum großen Teil noch überein.  Mir persönlich ist schlußendlich ein guter Kontrast(höhere Dynamik) des HDR-Videobildes wichtiger als eine großflächig hohe Spitzenhelligkeit(die mich altersbedingt blendet) auf meinem 55" LG OLED UHD-TV. Statt "Papierweiß" bei SDR bekommt man jetzt "Schneeweiß" im Falle HDR(HLG). Bei einer Transformierung von Rec 2020 zu Rec 709 verliert man fast die Hälfte der Farbqualität. "Beim sofortigen HDR-Workflow dreht sich alles um Geschwindigkeit. Nehmen Sie Inhalte mit Hybrid Log-Gamma (HLG) auf, bearbeiten Sie sie und zeigen Sie sie an, um Inhalte schnell zu liefern, ohne Kompromisse bei Ausdrucksstärke und Qualität einzugehen." rät z.B. Sony. Wie Nit Levels im HDR-Video wirken: Klick! Situationen mit unterschiedlicher Helligkeit und Untershiede im Kontrast

Auf dieses Bilddetails müssen wir uns konzentrieren damit dort an der hellen Stelle die "Zeichnung" noch erhalten bleibt und nichts ausbrennt. Die Nits in den beiden Screenshots können wir auf dem Videoscope ablesen.

HDR-Monsterguide von Jon Pais: Klick! Duales Grading HDR(HLG) verfügt über einen standardisierten OETF, mit dem man Daten direkt mit einer Kamera erfassen kann. Es wird dann über einen inversen OETF und das System OOTF in das Vorführ-Display zurückgebracht. Hier ist dann das Display für die Signalwertverteilung zuständig. Deshalb wird HDR(HLG) auch häufig als Display-Videomaterial bezeichnet. HLG ist die einzige Möglichkeit ohne separaten SDR-Export ein HDR Video auf einem SDR Monitor anzuschauen. Mit PQ geht das nicht. Mit HLG stimmen zumindest die Farben bei SDR Monitoren noch möglichst gut. Da man bei der Farbkorrektur auf das HDR und SDR achten muss, schliesslich soll das HDR Video noch ansehbar bleiben bei Wiedergabe auf dem SDR-Display, spreche ich hier vom Dualgrading. ARD-Digital erklärt HDR: KLick! ARD-Digital erklärt - High Dynamic Range: Mehr Farbe, mehr Kontrast, mehr Sehvergnügen: Klick! Aktuellste Information über die Eigenschaften von Hybrid Log Gamma: Klick! "Zwar ist die Transferfunnktion von HLG theoretisch mit einem Kontrastumfang von 12,5 Blenenstufen definiert, jedoch hat sich gezeigt, dass die oben beschriebene Kompatibilität nicht funktioniert und HLG-Programme auf SDR-Fernsehgeräten zu dunkel wiedergegeben werden. Daher wird HLG höher ausgesteuert, was den Kontrastumfang auf 11 Blendenstufen reduziert, das HLG-Bild auf SDR-Geräte heller erscheinen lässt." Meine eigenen HDR(HLG) - Aufnahmen filme ich mit einer Belichtungskorrektur von +0,3, keinesfalls mit Unterbelichtung! In DaVinci Resolve Studio kann man das relativ einfach oder sehr vielfältig sicher realisieren. Folgendes Videomaterial ist von Editors Keys in HDR(HLG-Gamma) auf YouTube hochgeladen worden. Auf dem PC-Monitor wird das darstellbare SDR-Video von YouTube so angezeigt:  Zahlreiche Spitzenlichter sind bei dieser Aufnahme auf dem SDR-Monitor zu sehen

Szene aus diesem Video: Klick! Mittels Verstellung der Grading-Regler(Kontrolle auf den Scope & am HDR-TV) kann man feststellen welche Wirkung man für das HDR(auf dem HDR-TV)- und gleichzeitig SDR-Bild(auf dem SDR PC-Monitor) erzielt und so festlegen was für den eigenen Eindruck visuell das beste herausgeholt wird.bei einem dualen Grading. Das funktioniert wirklich, wenn man die beiden unterschiedlichen Sichtgeräte vorher gut aufeinander abstimmt. Mit dem "Dualen Grading" schafft man es durchaus für den HDR-TV zu graden und gleichzeitig bei der Betrachtung auf dem SDR-Sichgerät ein zufriedenstellendes Ergebnis zu bekommen.  Beispiel aus einem Dualgrading: SDR-Videobild aus einem eigenen Video

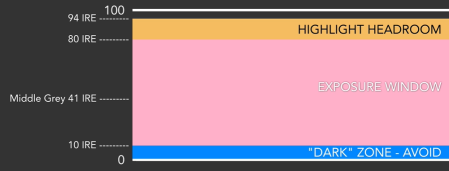

Das Gleichgewicht in Bezug auf die Helligkeit muss stimmen – nur weil man 1.000 nits erreichen kann, bedeutet das nicht, dass man das auch tun sollte. Manchmal ist es am besten, HDR nur dezent zu nutzen. Einen recht guten Artikel über das Filmen und Grading für HDR-Video findet man hier: Klick! Auf

em SDR-Monitor wird die Helligkeit der Spitzlichter bis zu 100 Nits mit

einem Gamma von 2,2* z.B. im "HIGHLIGHT HEADROOM" dargestellt, auf dem

HDR-Monitor werden die Spitzlichter mit identischen Projektmeterial

dagegen bis zu 1000 Nits mit dem speziellen HLG-Gama angezeigt

was dort ein viel brillanters Bild liefert mit frischeren Farben und

besserer räumlichen Tiefe. Falls der HDR-TV die 1000 Nits nicht zeigen

kann wie mein LG OLED HDR-TV der max. 650 Nits zeigt, dann werden die

hellen Stellen die darüber gehen abgeschnitten. Der L-OLED zeigt aber

trotdem ein besseres Bild, weil in der "DARK Zone" echtes Schwarz

angezeigt wird an Stelle von einem Dunkelgrau.

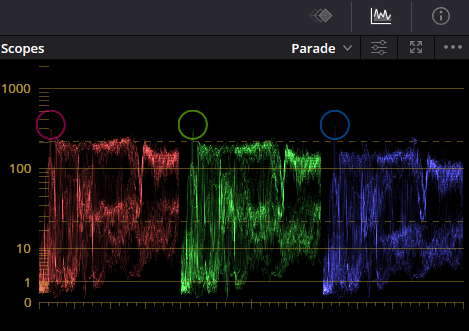

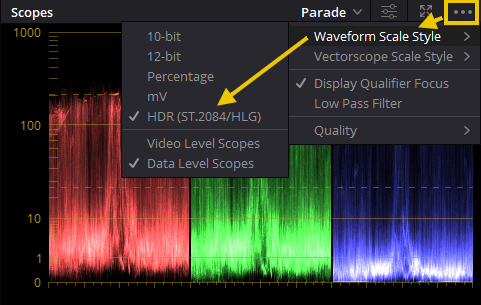

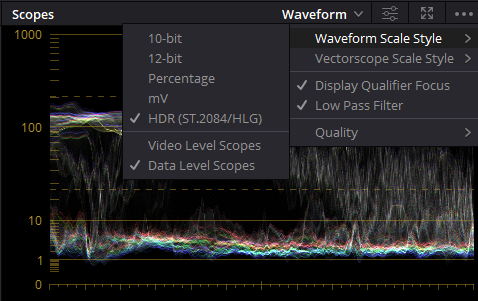

* Gamma 2,2 oder 2,4?: Klick! Wer mit dem erzielten Ergebnis im Falle SDR nicht zufrieden ist, der muss zwei voneinander unabhängige Videos graden. Man weiß nicht, in wievielen Haushalten noch SDR-TVs oder PCs ohne HDR-Sichtgeräten stehen, deshalb müssen die TV-Sender HDR-Produktionen noch mit dem Dual-Grading zu Verfügung stellen, damit auch die SDR-Empfänger noch an der Produktion teilnehmen können. In meinem Fall sehe ich mir meine Eigenproduktionen immer auf HDR-Sichtgeräten an seit dem ich über die Möglichkeit verfüge in HDR zu filmen. WDR - TV Produktion: Norwegen in UHD-HDR gefilmt Making of Wunderschön Norwegen - Wie entsteht eine WDR-Reisedoku? Klick-1 Norwegen - Der Westen von Sognefjord bis Bergen (4K UHD) Klick-2 Das Video kann man als MKV-Videodatei in UHD als HDR(HLG) runterladen. Mein 55" OLED LG HDTV erkennt das Zuspielvideo von der USB-Festplatte selbsttätig als HDR(HLG) Video.  Eher zurückhaltendes HDR-Grading, hier SDR-Bild Oszilloscope einrichten: Eine gute Einführung dazu findet man hier: Klick!  YRGB-Scope für SDR-Video in %  RGB-Parade-Scope mit Qualifier-Anzeige in Nits

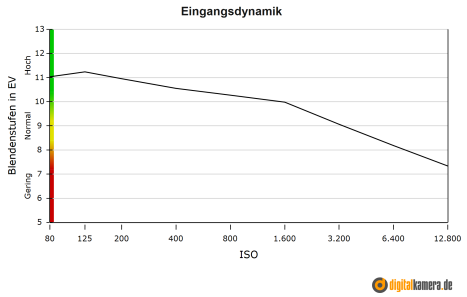

Die hellste Luminanzstelle im DaVinci Player auf dem PC-Monitor liegt auf den Schildern

die an der Natursteinmauer angebracht worden sind. Man kann das Ergebnis nach dem Nits-Wert qualifizieren oder nach der Sichtkontrolle auf dem HDR-TV am Arbeitsplatz, was ich bevorzuge. Siehe auch: Sichtkontrolle How to use resolve SCOPES - In-depth with a Pro Colourist: Klick! Untertitel mit Übersetzung hierbei im Browser einschalten! Hinweis zum folgenden YT-Link: "Das Farbmanagement in DaVinci Resolve kann überwältigend sein, oder vielleicht wissen Sie noch gar nicht, was Farbmanagement ist. In diesem Video erkläre ich Ihnen, wie Sie das Farbmanagement in DaVinci Resolve für Ihr V-log-Material einrichten, was zu tun ist, wenn Sie mit gemischtem Material arbeiten müssen, und wie Sie mit Plugins wie Dehancer umgehen. Aber ich bin kein Experte auf diesem Gebiet, also habe ich mir Hilfe geholt. Mit mir in diesem Video ist Daria Fissoun. Sie haben sie vielleicht schon auf YouTube und auf Veranstaltungen wie der ResolveCon gesehen. Sie ist Coloristin, Compositorin und zertifizierte DaVinci Resolve-Trainerin. Sie ist auch die Autorin des Colorist Guide to DaVinci Resolve. Man kann also mit Fug und Recht behaupten, dass sie ein oder zwei Dinge über Farbe und DaVinci Resolve weiß." Video auf YouTube: Klick! HDR(HLG)-Aufnahmesetting: Nach der Anschaffung der Sony Kompaktkamera ZV-1 in 2021 habe ich Gefallen gefunden an der Aufnahme mit dem HDR Video Assist-Display von vorführfertigen HDR(HLG3) Videomaterial für meinen 55" LG OLED HDR-TV. Ich bekomme aus der Kamera HDR(HLG) als vorführfertiges kompatibles Videomaterial geliefert für HDR-TV/SDR-TV mit nur einem geringen Anpassungsbedarf im Videoschnittprogramm. HDR(HLG) wird hier noch genauer erklärt: Klick! "Zwar ist die Transferkennlinie von HLG theoretisch mit einem Kontrastumfang von 12,5 Blendenstufen definiert, jedoch hat sich gezeigt, dass die oben beschriebene Kompatibilität nicht funktioniert und HLG-Programme auf SDR-Fernsehgeräten zu dunkel wiedergegeben werden. Daher wird HLG höher ausgesteuert, was den Kontrastumfang auf 11 Blendenstufen reduziert, das HLG-Bild auf SDR-Geräte heller erscheinen lässt." HLG-Inhalte sind Display-neutral und können deshalb mit SDR- (Standard Dynamic Range) und HDR-Geräten wiedergegeben werden. Was ist HLG und wofür sollte es eingesetzt werden?: Klick! An anderer Stelle wird ergänzt: HLG verfügt über einen standardisierten OETF, mit dem man Daten direkt mit einer Kamera erfassen kann. Es wird dann über einen inversen OETF und das System OOTF in das Vorführ-Display zurückgebracht. Hier ist dann das Display für die Signalwertverteilung zuständig. Deslab wird HLG auch häufig als Display-Videomaterial bezeichnet. Die ZV-1 Cine-Camera mit ND-Filter kann UHD-Videos durch Oversampling von 5K mit bis zu 30 BpS aufnehmen. Automatik ISO 125–12800, wählbar mit Ober-/Untergrenze. Die Eingangsdynamik bewegt sich bis ISO 1.600 auf einem hohen Niveau von über zehn Blendenstufen, bis ISO 200 sind es sogar um die elf Blendenstufen. Oberhalb von ISO 1.600 sinkt der Dynamikumfang linear ab und verliert eine Blendenstufe pro ISO-Empfindlichkeitsstufe lt. Messungen von: Klick!  Es gibt verschiedene Methoden der Dynymiktestung, eine Methode ist hier sehr genau beschrieben: Klick!  Cinema-Kamera

die mit viel Technik wunderbar in der Hand

liegt.

Die Aufnahmen entstehen in der Kamera per Sony-Hybrid HLG3-Workflow, die Aufnahmen kann man deshalb direkt mit dem HDR-TV abspielen.  HLG-HDR Testcharts: Klick! HDR-HLG 4K-Videomaterial von der kleinen Sony ZV-1: Mit MediaInfo bekommt man eine Auskunft über die im Video gespeicherten Metadaten die für die Wiedergabeerkennung am TV wichtig sind.  So nimmt man HDR(HLG3)-Videos auf(von Alister Chapman verfaßter Beitrag): Klick!

"Beim Filmen in HDR ist keine andere Belichtung erforderlich als bei SDR (Standard Dynamic Range). Ich glaube, viele Menschen denken, dass sie für HDR heller belichten müssten, aber in der Regel ist das nicht so. Sie müssen bedenken, dass HDR einen hohen Dynamikbereich bedeutet. Es geht um den Bereich, den Sie erfassen, nicht nur um die Helligkeit. Gesichter, Menschen, Pflanzen und Gebäude sollen in HDR nicht heller sein als in SDR, sie sollten gleich aussehen und gleich belichtet werden. Ein HDR-Fernseher kann jedoch Highlights wie Reflexionen von glänzenden Oberflächen oder einen sehr hellen Himmel anzeigen und gleichzeitig Details und Texturen in den dunklen Schatten darstellen, die normalerweise auf einem SDR-Bildschirm verloren gehen. Der Schlüssel liegt also darin, den mittleren Bildbereich korrekt zu belichten, und dann sollten die sehr hellen und sehr dunklen Bereiche sich von selbst ergeben." Da das Sony-Kamerameterial nur in 8 Bit Farbtiefe vorliegt(genauso wie bei einer teuren Prosumer Kamera Sony Alpha 7III), muss man einige Einschränkungen in der Nachbearbeitung beachten und das Videomaterial zunächst zu ProRes 422 10Bit zu transformieren(Bitrate max 500 Mb/s). HDR(HLG)-Projektsetting in Davinci Resolve 18.1.1: Falls man eine HDR-Videodatei will die geeignet sein soll für eine gute SDR- & HDR.Wiedergabe, dann muss man dem Schnittprogramm eine Hybrid log Gamma Videoaufnahme zuführen oder erst im NLE herstellen um das Color-Grading ausgewogen zu gestalten. Die Aufnahme sollte mit einer Belichtungskorrektur von min. + 0,3 aufgenommen werden, niemals unterbelichtet und vorzugsweise nach rechts exponiert(ETTR) um ein zufriedenstellende Ergebnis zu bekommen..  Hier ein Internetfund mit

einer einer praktischen Beschreibung von Filmmaking

Elements zum Umgang

mit 8 Bit Video im Color-Arbeitsraum: Klick!

Es geht hierbei um die Bearbeitung von Farbkorrekturen mit gewissen Werkzeugen im Color-Arbeitsraum mittels derer das Bild zerfallen kann und die man deshalb besser meidet und andere Werkzeuge benutzt. Ferner wird empfohlen ausschließlich nur 8 Bit Videomaterial in DaVinci zu importieren welches davor per Transform in ProRes 422 10Bit gewandelt worden ist. damit kann man viel effizienter arbeiten. Einige Tipps daraus die dort näher erläutert werden:

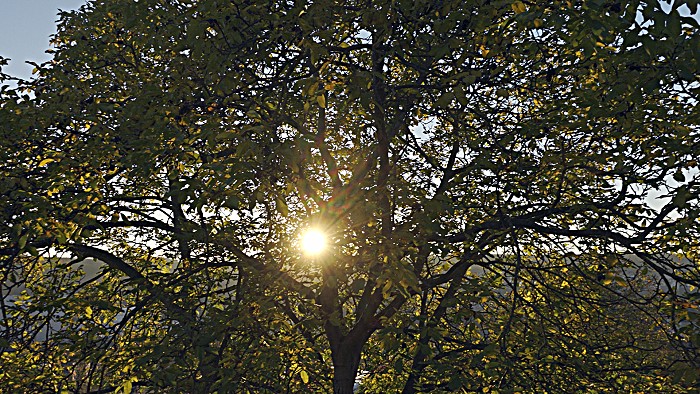

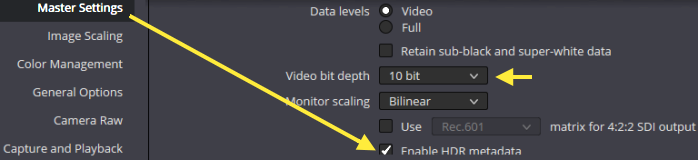

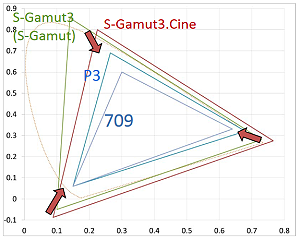

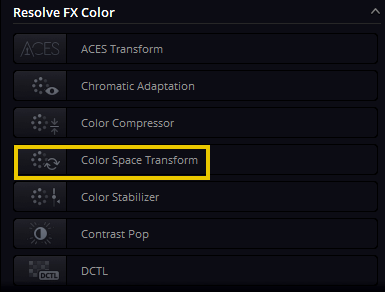

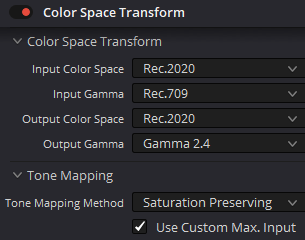

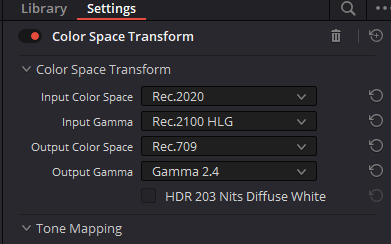

Allerdings ist die Farbkorrektur in Resolve für das HDR(HLG) Videomaterial der Sony ZV-1 Kamera ähnlich einfach nachzuarbeiten wie schon in Edius, man braucht dafür nicht unbedingt viel von der verfügbaren Werkzeugen in Resolve.  Generelle Preferences Einstellung in der Top-Menüleiste DaVinci Resolve  Sicherheitshalber "Enable HDR metadata aktiviert", das es Sichtgeräte gibt die diese Medaten benötigen, andere dagegen nicht. Mischt man SDR-Aufnahmen oder JPG-Bilder in das HLG-Projekt dann muss man den Farbraum mit Color Space Transform auf dem ersten Node legen und dort an das Project anpassen. Was auf meinen Schnittplatz landet ist nicht mit Prosumer High-End-Kinokameras gedreht. In meinem Fall verfüge ich über HDR(HLG3) 8 Bit Videomaterial von der Sony ZV1 im Farbraum Rec.2020. Ferner liegt mir 8 Bit Videomaterial von der GoPro Hero 7 Black in Rec. 709, DJI-Pocket 2, DJI-Mini-Drohne und der Panasonic FZ300 und von dem Huawei Mate 20 vor. Dieses Videomaterial wird nicht plötzlich verschwinden, deshalb muss man lernen wie man damit umgeht um ein gutes Ergebnis zu bekommen. Von SDR zu HDR: Klick! Inverse Tonmapping - Hochskalieren von SDR auf HDR: Klick!  Farbraumunterschiede SDR/HDR  Die Lage von S-Gamut3.Cine(ähnlich dem Kinofilm) Folgende HDR(HLG3) der Sony ZV-1 Videoaufnahme ist lediglich mit Blur-Sharpen in DaVinci Resolve Studio nachbehandelt worden:  An der Originalaufnahme ist lediglich das Blur-Sharpen

eingestellt worden

weil die Kameraaufnahme mit herausgedrehter Detail-Schärfe(-7) erfolgte. Die Wirkung der Reglereinstellung ist am besten auf dem 32" HDR(HLG) TV kontrollierbar! Color Space Transform - was ist das? Diese Funktion die man im Falle vom Projektsetting abweichenden Farbraum-Schnittmaterial (Bilder, Grafiken, normale Videoaufnahmen von anderen Kameras) auf den ersten Node einer Szene im Color-Arbeitsraum legt passt lediglich den Farbraum an das Projektsetting an, der Export erfolgt so wie im Projekt-Setting voreingestell, in meinem Fall meist "Output Color Space HDR HLG"  Transform eines Sony S-Log3 Videos in ein HLG-Projekt:   Videoframe-Transform, hier für den normalen PC-Monitor. Transform eine JPEG Bildes in ein HLG-Projekt   JPEG-Bildtransform(hier eine Simulation für den normalen PC-Monitor. Farbkorrektur und Color Grading für HDR(HLG)-Export: So lief das Grading der ersten HLG-Produktionen beim ZDF im Jahre 2019: Klick! Anforderungen des ZDF "Grading von HD/HDR und UHD/HDR-Produktionen": Klick! Zitat dazu im obigen ZDF-Bericht: "Es entstehen zwar Banding-Artefakte – das muss man ganz klar sagen. Die treten besonders dann auf, wenn man massiv in das Grading eingreift. Aber es gibt Plug-Ins wie zum Beispiel ,Neat Video‘, die das Banding, aber auch Rauschen und Datenreduktions-Artefakte wieder sehr gut in den Griff bekommen.“ Selbst im Varicam-Material konnten Frank Flick und Walter Freund das gefürchtete Banding beobachten. „Wenn ich in der Farbkorrektur gerade für HLG dann so weit aufreißen muss, um die Kontraste auf ein Maximum rauskitzeln, dann habe ich da unter Umständen auch Banding-Artefakte, obwohl es in 10 Bit aufgezeichnet ist“, beschreibt Walter Freund seine Erfahrungen." Zitat aus "Monitorhelligkeit und Bildhelligkeit" von Tobias Wiedmer zum Grading von HDR : Klick! "Im Vergleich zu einem SDR-Klasse-1-Monitor hat ein HDR-Monitor einen tieferen Schwarzwert und einen helleren Weißwert. Nach den aktuellen Standards kann der Weißwert bis zu 10.000 Nits betragen und der Schwarzwert annähernd 0 Nits. Ein aktueller SDR-Klasse-1-Referenzmonitor wird dagegen auf 100 Nits kalibriert, der Schwarzwert beträgt max. 0,05 Nits. Dass der Monitor heller ist, heißt aber im Optimalfall nicht, dass der Bildinhalt auch heller sein muss. Würde man im Grading alles proportional heller korrigieren, ohne die Verhältnisse zu ändern, würde aller Wahrscheinlichkeit nach das Bild ästhetisch nicht mehr als schön empfunden werden. Man gewöhnt sich an die Helligkeit und verspielt damit den Vorteil von HDR. Ein Bild, das keine besonderen Lichter enthält, sollte ähnlich aussehen wie ein SDR-Bild. Zum Einsatz kommt das Potenzial von HDR also nur, wenn besonders helle Lichter (oder besonders tiefe Schwärze) dargestellt werden sollen, die sich vom Rest des Bildinhalts stark abheben sollen." Die Daejeon-Chroniken: Hier bekommt man sehr viele gute Informationen über HDR-Technologien, Workflows, Tutotrial, Neuigketen und Meinungen auf dieser Homepage: Klick!  Ich selbst bin seit 2021 - seit der Beschaffung einer HLG-Aufnahmekamera Sony ZV-1 - "abhängig" von HDR(HLG3) und komme wegen der Einfachkeit des Workflows von der Aufnahme bis zum Ergebnis nicht mehr davon weg. Als Hobbyvideofilmer habe ich lange darauf warten müssen um Aufnahmen im erweiterten Farbraum BT.2020 statt BT.709 mit der Videokamera einfangen zu dürfen, zudem noch mit einem Leuchtkraftzugewinn bei den Highlights was zu besonderen lokalen Glanzlichtern führt. HDR kommt der Realität näher. Ist der Himmel grau, dann kann man von HDR(HLG3) was die Glanzlichter angeht nicht profitieren. Hier hilft nur noch der Austausch des Himmels was mit DaVinci Resolve natürlich ebenfalls realisierbar ist, siehe(Sky Replacement): Klick! Nicht unerheblich ist für mich, dass ich daraus sehr einfach eine SDR-Fassung für meine Freunde produzieren kann. Wie man evtl. Problemen - die im ZDF-Bericht erwähnt sind wegen 8 Bit Videomaterial entgegen wirkt - steht hier in einer Beschreibung von "Filmmaking Elements" zum Umgang mit 8 Bit Video im Color-Arbeitsraum von DaVinci Resolve: Klick! Die neue DJI Pocket 3 Gimbal-Kamera (Anschaffung in 06/2024) liefert aus der Kamera heraus berrits HDR(HLG) Videomaterial in 10Bit Farbtiefe und damit in einer besseren Farbabstufung. Die hier - Klick! -gelisteten Einschränkungen des 8bit-Materials gibt es somit bei dem Color-Grading nicht mehr. Clip-Konvertierungen zu HQX sind nur dann sinnvoll, wenn das PC-System auf Grund seines Alters Performance-Probleme haben sollte. Bislang bewegte sich der Helligkeitsbereich für Bildinhalte im SDR-TV zwischen 0.05 und 100 Nits was in etwa das Spektrum vom Mondlicht bis zu dem Licht einer Lampe abdeckt. Mit Hilfe des Waweform-Scopes - etwa in DaVinci Resolve - pegelt man den Hauptanteil der Lichter auf den max. Wert von 100 Nits. Nur kleine Flächenanteile blinzeln noch etwas je nach Fähigkeit des SDR-TVs.  Der Leuchtkraft-Zugewinn bei einem HDR(HLG)-TV wird von mir kontrolliert mit dem Waveform-Scopes in DaVinci Resolve auf die gestrichelte Grenz-Linie also auf ein höheres Niveau gepegelt. Nach den Empfehlung von ITU HDR Reference sollte das diffuses Weiß bei 203 Nits* liegen, siehe Klick und hier: Klick! * in der Anleitung zum NLE DaVinci Resolve - siehe Seite 230 - wird im Falle von Remapping von SDR-Inhalten auf HDR von 100 nits auf 203 Nits (definiert als der diffuse Weißwert) gemäß der BT.2100-Empfehlung vorgeschlagen bei Einsatz vom Plug-in Color Space Transform Resolve FX. Dadurch können die Spitzlichter von SDR-Material besser mit den deutlich helleren Spitzlichtern von HDR-Inhalten konkurrieren, so dass die SDR-Weißtöne im Vergleich zu diffusem Weiß in HDR weiterhin weiß und nicht grau erscheinen. HDR-Referenz für Weiß:  Wenn die Weißwerte der Grafiken zu hoch eingestellt sind, zerstören sie die Wirkung von Lichtern im Bild, weshalb einige Studios auf maximal 203 cd/m2 bestehen, es sei denn, es gibt einen zwingenden Grund, etwas anderes zu tun. Siehe auch hier: Klick! Großflächige spektakuläre Highlights meide ich persönlich, da Sie mich altersbedingt blenden und kein ausgewogenes schönes Bild für mich liefern. In meinem Fall liefert der 55" LG OLED 4K HDR-TV bei obiger Pegelung der Waveform- Scopes ein sehr gutes Bild. Die HDR-TVs können die Leuchtkraft der Lichter sogar noch höher darstellen, eine bindende Vorschrift für den Coloristen besteht allerdings nicht wie die Diskussion im Blackmagis-Forum aufzeigt. Viele Indie-Filmemacher verwenden HLG für SDR-Produktionen was nicht der beste Weg ist. Indie-Filmemacher sind Filmschaffende, die unabhängig von Förderungen und ohne Vorgaben von Produktionsfirmen professionelle Filme herstellen. "Filmmaking-Elements" schlägt für diese Filmer folgendes "Color Space Transform" vor:  Quelle für die Nachbehandlung von Sony HLG(PP10) um sogar SDR-Format aus HLG zu generieren: Klick!  SDR-Herbsstimmung im Oktober 2022

Sony verdient eine Anerkennung für die Implementierung von Sony-HLG, da es den S-Log- Implementierungen in mehr als einer Hinsicht weit überlegen ist. Ein wesentlicher Aspekt dieser Überlegenheit ist, dass die Hybrid Log Gamma-Implementierung einen maximalen Dynamikbereich eines Sensors ermöglicht. Es gibt aber auch Leute die sich darüber aufregen weil Sony Kameras mit 8 bit Farbtiefe mit 4:2:0 Chroma-Subsampling statt 10 bit mit 4:4:4 für die Kamera-Baureihe bis hin zu den großen Systemkameras mit Wechsekoptik angeboten hat, siehe hier: Klick  Sofortiger HDR-Workflow

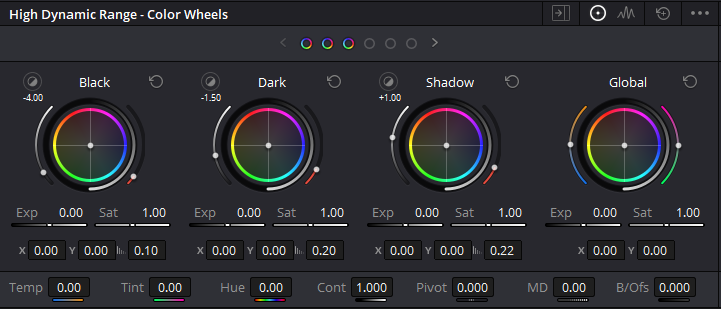

Sony hat den "Instant HDR-Workflow" mit HLG1,2 und 3 bei seinen Kamera eingeführt um die Aufnahmen direkt auf einem geeigneten HDR-TV ohne weiterem Color-Grading vorführen zu können. Wichtige Nachricht, die Timeline stellt DaVinci Resolve bei jedem Projekt immer automatisch auf 10 Bit selbstständig ein was weniger Probleme bei dem nachfolgenden Color-Grading bereitet. Das hilft Treppeneffekte(Banding) bei Farbabstufungen zu verhindern. Ich arbeite in der Resolve-Timeline mit bereits grob vorgeschnittenen und schon bestens nachstabilisierten ProRes 4:2:2 10 Bit Videomaterial. Es gibt keinerlei Performance-Probleme. Die Vorschau wird gleich über eine I/O-Videokarte auf einen HDR-TV ausgegeben. Genauigkeit der Farbdarstellung - 4:2:0 oder 4:2:2: Klick! Das sollte man lenen - der komplette "Farbtopf" in DaVinci Resolve: Klick! Für umfangreicheres Color-Grading gibt es In der High Dynamic Rage Werkzeuge für die Primäre Farbkorrektur, um Feinheiten herauszuarbeiten, in meinem Fall wird HDR nachgearbeitet:   Primaries-Farbräder

Diese Drehregler kann man je nach Vorliebe für HDR und SDR einsetzen, allerdings ist die Bedienung nicht besonders feinfühlig, hierzu unbedingt mal diese Erklärung ansehen: Klick! Manche Coloristen bevorzugen die Einstellung per Zusatzinvestition in das "Blackmagic Tangent Ripple... Ich persönlich arbeite lieber mit den Kurven und deutlich feiner die Farbkorrektur zu regeln. Im Falle von "Curves - Customs" gibt es neben der Custom-Einstellung noch sechs weitere Einstellkombinationen.   "Während Ihnen die „Primaries“-Farbräder gröbere Kontrolle geben, gestatten es Ihnen die Kurven, die Farbe und den Kontrast in einem Bild deutlich feiner zu modellieren. Kurven werden über die erste Option in der mittleren Toolpalette aufgerufen. Jede Kurve ist individuell anpassbar, um einen Bildbereich nach Farbton, Luminanz oder Sättigung zu verändern. Mit den regulären „Custom“-Kurven lassen sich die roten, grünen und blauen sowie die Luminanzkanäle einzeln ändern. Dabei können Sie sich zur Orientierung ein Live-Histogramm dazuschalten. In fünf weiteren Kurven können Sie ein Element wie Farbton auswählen und darin zugleich einen anderen Aspekt wie Luminanz oder Sättigung anpassen. Zum Beispiel wählen Sie in der Farbton-vs.-Sättigungs-Kurve einen Farbton aus und ändern dann die Sättigung dieses Farbtons." Tipp: Klick!  Der Color-Arbeitsraum in diesem Setting dient dazu bei einem jeden Videoclip Farbkorrekturen in jedem Farbkanal schnells möglich unabhängig voneinander durchzuführen, z.B. um kleine Farbstiche zu entfernen. Im obigen Beispiel sind die Farben eines einzigen Clips per "Color Space Transform" schnell auf alle anderen Clips übertragen(Nodes kopiert) worden. Anschliessend sind die Farbkanäle YRGB je nach Bedarf und Kontrolle auf dem angeschlossenen HDR-TV dosiert worden. Einzig

das HLG

Videomaterial der Sony ZV-1 oder DJI Pocket 3 kann praktisch sofort auf einem HDR-TV

abgespielt werden, es sind nur noch geringe Belichtungs- und Farbkorrekturen z.B. bei Landschaftsaufnahmen oder Street-Touren nötig. HLG ist die einzige Möglichkeit ohne separaten SDR-Export ein HDR Video auf einem SDR Monitor anzuschauen. Mit PQ geht das nicht. Grundsätzlich wird meine HLG-Kameraufnahme im Wide-Gamut Farbbreich nachbehandelt, auch kontrolliert mit Scopes und visualisiert auf einem HDR-TV auf meinem Schnittplatz. Optional wird am Ende erst eine technische Transform LUT aufgelegt, falls HLG3 in Rec.709 final exportiert werden soll.  Da die obere Aufnahme aus der Kamera kaum über Spitzlichter am bedeckten Himmel verfügt, habe ich die Luminanz hauptsächlich in den Mitteltönen angehoben. HDR-TV-Video-Frame

und Scopes dazu, der Screenshot oben stammt vom RGB PC-Monitor.

Auf dem HDR-TV ist die Leuchtkraft in den Lichtern natürlich höher. Lesen Sie auch die Bedienungsanleitung für den Color-Arbeitsraum ab Seite 2845. Profis machen sich viel mehr "Aufwand" bei der Farbkorrektur wie man es beispielhaft im folgenden Knotenbaum sieht:  Simples Video mit unnötig viel Aufwand nachbehandelt.

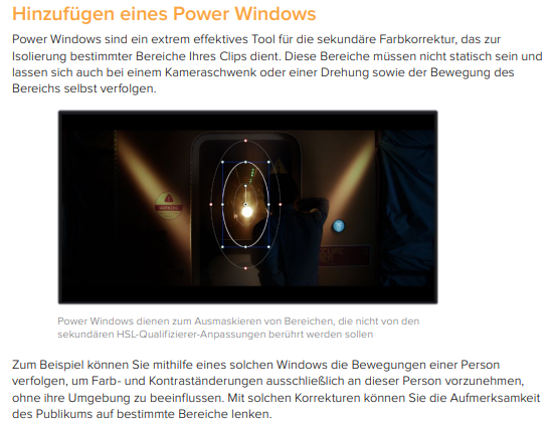

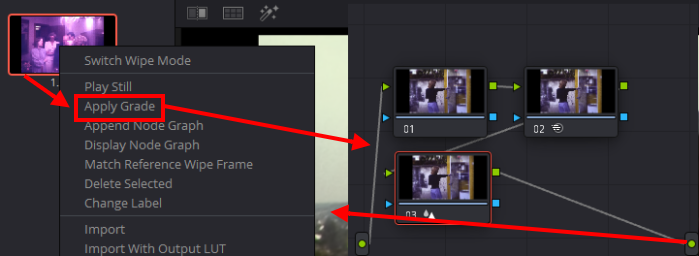

Tipp - Heller, wie aber? Slashcam: Klick! Dort bei SlashCam findet man noch weitere Tipps für das Colorgrading, wie z.B.: ACES, Full Data Swing, versteckte Dynamik, HDR Basics, usw. ... Tipp für bestens gelungene lokale sekundäre Farbanpassungen: Power Wndows ist ein sehr effektives Tool für die sekundäre Farbkorrektur, das zur Isolierung bestimmter Bereiche des Clips dient. Dieser Bereiche müssen nicht statisch sein und lassen sich auch in Szenen mit Kamerabewegungen einsetzen. um z.B. Farb- und Kontraständerungen ausschließlich nur in einem bestimmten Bereich zu beeinflussen ohne der Gefahr das ganze Bild zu zerstören.  Quelle: PDF von Blackmagic Seite 423 Da das HLG3 - Videomaterial mit vollkommen herausgedrehter Schärfe(-7!)*** aufgenommen worden ist, muss es im NLE nachgeschärft werden und ggf. entrauscht werden falls es bei zu wenig Licht aufgenommen worden ist. Dafür gibt es neben "Sharpen" verschiedene andere Möglichkeiten, z.B. "Contrast Pop" oder besonders gerne in schwierigen Situationen das "Blur Sharpen"..., man erkennt nicht immer ganz genau was man mit den Steuerwerkzeugen darin eigentlich macht. Über dem Viewer gibt es aber die Schaltfläche "Highlight" mit A/B-Modus für eine besere Beurteilungsmöglichkeit. *** Der Schlüssel zum präzisen Schärfen und Rauschunterdrückung: Klick! Ich arbeite gerne damit, allerdings suche ich mir immre eine Stelle im Videobild aus bei der ich ganz klar erkennen kann wie sich die Reglerstellung auf die Nachschärfung auswirkt, das kann ein stark vergrößertes(200-300%) Detail auf dem Player im Color-Arbeitsraum sein wie etwa ein Blatt am Baum, ein Ast, ein Strohhalm, ein Fensterkreuz, ein Gitter oder Haare. Beachtet man das nicht, kann der Nachschärfeversuch in das Gegenteil schlagen und das Bild zerstören. Das Videobild sollte nach der "Nachbehandlung" auf dem Kontroll-HDR-TV in den feinen Strukturen auf keinen Fall flimmern, also nicht überschärft wirken! Den Colorgrade eines Videoclips auf einen oder mehrere andere Clips übertragen: Timeline-Clip eine Farbkorrektur die gefällt und die als Referenz auf andere Video-Clips übertragen werden soll im Color-Arbeitsraum: Zunächst markiert man die Clips auf der Timeline welche die Farbkorrektur des Referenzclips bekommen sollen. Jetzt wird der Referenzclip mit der rechten Maustaste angeklickt. Es geht jetzt ein Kontexmenü auf in dem wir die Funktion "Shot Match to This Clip" anklicken. Nach einer kurzen Berechnungszeit bekommen alle davor markierten Clips die Farbkorrektur des Referenzclips. Sollen Clips noch etwas weiter mit den Farbkorrekturwerkzeugen nachgearbeitet werden, dann muss vor dem Übertragungs-Node des Referenzclips noch ein Farbkorrektur-Node eingefügt werden in dem man das dann macht.  Simpler: Korrigierten

Clip auswählen -> Rechtsklick auf das Vorschaubild in der Mitte

-> Video-Anleitung dazu: Klick! Farbakkurate Anzeige beim Grading und Korrekturen: Die ersten Impulse für Farbkorrekturen habe ich aus den Büchern von A.Hurkman gesaugt. HDR-Grading von Alexis Van Hurkman: Klick! "Zitat hieraus: Es gibt keinen einheitlichen Ansatz für die Bewertung von HDR, und es gibt keine festen Regeln für die Zuordnung verschiedener Lichter zu verschiedenen Ebenen, genauso wie es keine Regeln für die Auswahl der Werte gibt, bei denen verschiedene Schattenebenen angezeigt werden sollen. Die Bewertung von HDR ist eine Frage der kreativen Entscheidungsfindung, die für jeden, der die Kontrolle über narrative Bilder ausübt, unglaublich spannend ist. Das heißt nicht, dass es keine technologischen Einschränkungen gibt, die es zu beachten gilt, wie viel Prozent des Bildes auf HDR-Hervorhebungsstufen eingestuft und auf Verbraucherdisplays genau wiedergegeben werden können."  Die Lichtersetzung erfolgt nicht pauschal bis zu der max. möglichen HDR-Helligkeit, sondern szenenbezogen je nach dem ob die Aufnahme bei Sonnenschein oder bedeckten Himmel bzw. im Schatten oder wenig Licht aufgenommen worden ist und wie Sie auf den Betrachter am besten wirken kann. Mit den Farbkorrekturen und dem Farbgrading beschäftige ich mich lediglich im Natur-Landschafts- und Dokumentations-Aufnahmebereich. Mit der Anpasung von Hauttonkorrekturen, Disco- oder Gamer- und plakativ lichtactionreichen Übertreibung der Farbauflösung beschäftige ich mich nicht. GRADING LEITLINIEN FÜR UHD HDR & SDR PRODUKTIONEN: Klick! Alles was man über HDR-Wiedergabegeräte wissen muss: Klick! Über wieviele Nits ein TV-Wiedergabegerät verfügen muss, hängt davon ab im welchen Umgebungslicht das Videobild ohne Anstrengung zu sehen sein soll ohne zu blenden und Kopfschmerzen dabei zu verursachen und die Augen gegen übertriebene 100% Bildschimhelligkeit vor Schäden zu schützen z.B. mit Hilfe einer aufgesetzten Schweißer-Schutzbrille. Mein Smartphone Huawei Mate 20 Pro ist standardmäßig für Videobetrachtung auf 6,2" OLED-Display bei Tages-Umgebungslicht auf [Vivid] eingestellt und es wird empfohlen, es so zu lassen. Der Modus bietet 508 Nits (manuell) maximale Helligkeit, aber es kann bis zu 660 Nits angehoben werden, wenn man es auf [Auto] stehen lässt. Die Maximalhelligkeit der HDR-Wiedergabe auf dem 55" OLED LG HDRTV liegt bei ca 650 Nits. Der LG-TV unterscheidet in Umgebungslicht zwischen "heller Raum" und "dunkler Raum". Die Sichtgeräte kann man damit auf Eignung für die HDR-Wiedergabe testen: Klick!  Es kommt also am Videoschnittplatz/Vorführplatz auf die personalisierte Balance an zwischen dem Umgebungslicht und der Leuchtkraft des Wiedergabedisplays an! Computermonitore zeigen Farben in RGB-Signalen an, bei Fernsehern sind hingegen YCbCr-Signale üblich. Aus diesem Grund zeigen beide unterschiedliche Farbspektren an. Die Ihnen auf einem Computermonitor präsentierten Farben unterscheiden sich daher ggf. von der Darstellung, die der Kunde auf seinem heimischen HD- oder Ultra-HD-Fernseher wahrnimmt. Um bei laufender Arbeit fundierte Farbentscheidungen treffen zu können, ist es bei der Farbkorrektur eines Videoprojekts wichtig, jeden Schritt auf einem HD- oder Ultra-HD-Fernseher wiedergegeben zu bekommen. Koppeln Sie Videogeräte jeder Art an die Blackmagic I/O Videokarte Intensity Pro 4K – von Standard-Definition-Fernsehern in analogem NTSC/PAL bis hin zu den aktuellsten digitalen HD- und Ultra-HD-Monitoren. So sehen Sie Ihre Arbeit immer in der richtigen Farbe!  Einstellungen im DaVinci Resolve Menü "Preferences" Eine geeignete

Sichtkontrolle für die Entwicklung

eines finalen HDR-HLG-Videos

auf dem Schnittplatz ist also nicht direct auf dem PC-Monitor möglich sondern

in

meinem Fall auf dem 32" HDR-TV

- [HDR10 + HLG]

in einem bei Tageslicht

abgedunkelten Schnittplatz-Raum. Hierbei wird für Kontrollzwecke

HDR(HLG) über die BM Intensity I/O Videokarte auf den HDR-TV am Schnittplatz eingespielt.

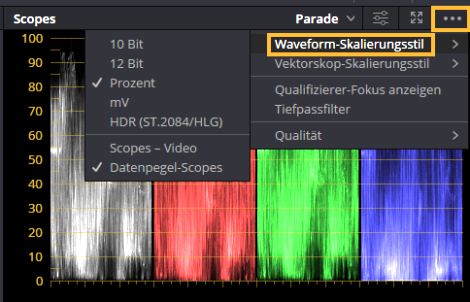

Bezüglich der folgenden Scopes siehe auch unter "Die Geltungsbereiche" bezüglich "Wellenform-Skalenstil > HDR (ST.2084/HLG)" in diesem Beitrag: Klick!  Scopes auf HLG Color-Grading umgestellt,

alles was über 100 auf der HLG-Skala zu sehen ist, wird auf dem HDR-Sichtgerät angezeigt, nicht auf einem SDR-Gerät...  Luminanz-Scope für Nachregelungen

Mir persönlich ist schlußendlich ein guter Kontrast(höhere Dynamik) des HDR-Videobildes wichtiger als eine stellenweise hohe Spitzenhelligkeit(die mich altersbedingt blendet) auf meinem 55" LG OLED UHD-TV.

HDR(HLG3) in DaVinci Resolve zurückhaltend farbkorrigiert wo nötig(verschiedene Lichtsituationen)

mit nachfolgenden LUT Color-Grading an einem Videoclp-Beispiel  Screenshot vom normalen PC-Monitor, vom HDR-TV kann man das leider nicht machen